RoSA: 一种高效微调大模型参数的新方法

随着语言模型扩展到前所未有的规模,对下游任务进行全面微调变得十分昂贵。为了解决这个问题,研究人员开始关注并采用PEFT方法。PEFT方法的主要思想是将微调的范围限制在一小部分参数上,以降低计算成本,同时仍能实现自然语言理解任务的最先进性能。通过这种方式,研究人员能够在保持高性能的同时,节省计算资源,为自然语言处理领域带来新的研究热点。

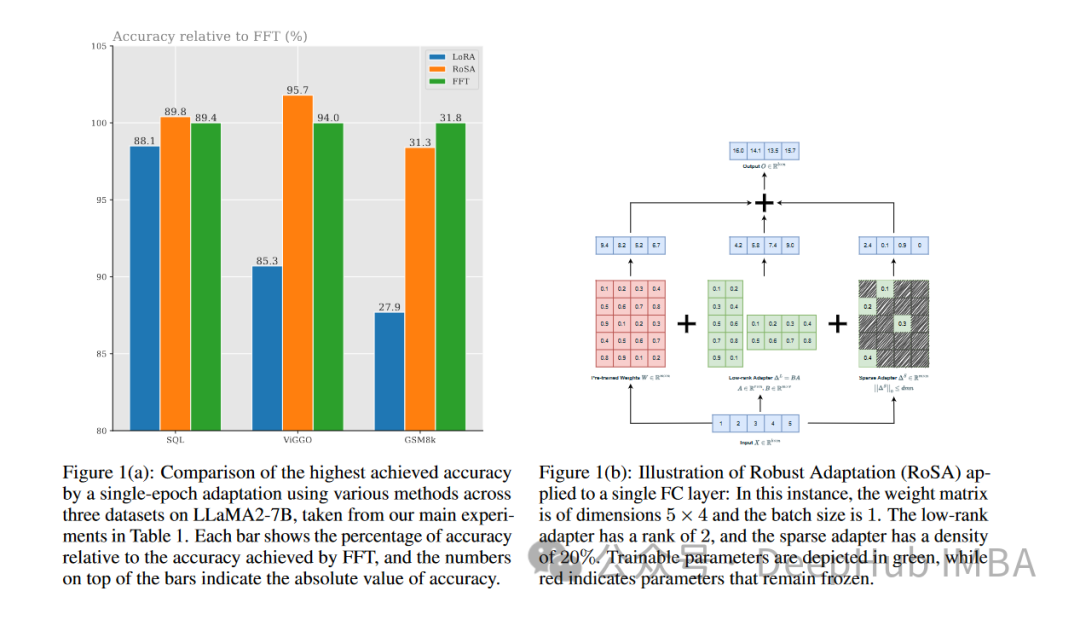

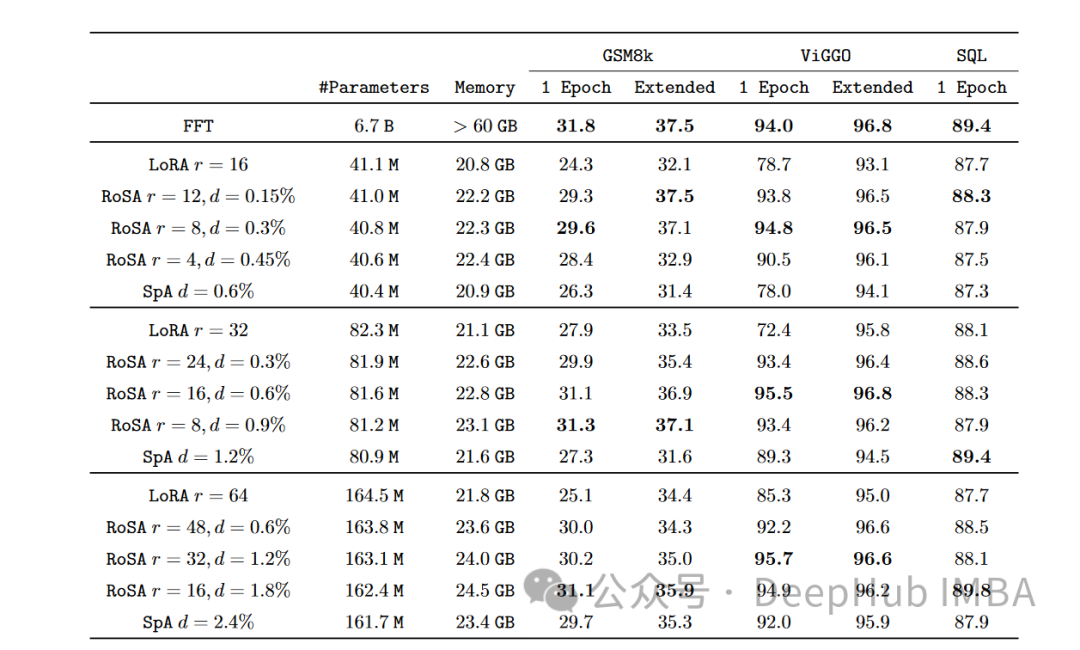

RoSA是一种新的PEFT技术,通过在一组基准测试的实验中,发现在使用相同参数预算的情况下,RoSA表现出优于先前的低秩自适应(LoRA)和纯稀疏微调方法。

本文将深入探讨RoSA原理、方法和结果,解释其性能如何标志着有意义的进步。对于希望有效微调大型语言模型的人,RoSA提供了一种新的优于以往方案的解决方案。

对参数高效微调的需求

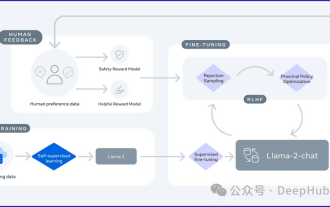

NLP已经被基于transformer的语言模型如GPT-4彻底改变。这些模型通过对大量文本语料库进行预训练,学习到强大的语言表征。接着,它们通过一个简单的过程将这些表征转移到下游的语言任务中。

随着模型规模从数十亿个参数增长到万亿个参数,微调带来了巨大的计算负担。例如,对于GPT-4这样一个拥有1.76万亿参数的模型,微调可能需要耗费数百万美元。这使得在实际应用中部署变得非常不切实际。

PEFT方法通过限制微调的参数范围来提高效率和准确性。最近有多种PEFT技术出现,权衡了效率和准确性的关系。

LoRA

一个突出的PEFT方法是低秩适应(LoRA)。LoRA是由Meta和麻省理工学院的研究人员于2021年推出的。该方法的动机是他们观察到transformer在其头部矩阵中表现出低秩结构。LoRA的提出旨在利用这种低秩结构,以降低计算复杂度并提高模型的效率和速度。

LoRA只对前k个奇异向量进行微调,其他参数保持不变。这样只需调优O(k)个额外参数,而不是O(n)个。

通过利用这种低秩结构,LoRA可以捕获下游任务泛化所需的有意义的信号,并将微调限制在这些顶级奇异向量上,使优化和推理更加有效。

实验表明,LoRA在GLUE基准测试中可以匹配完全微调的性能,同时使用的参数减少了100倍以上。但是随着模型规模的不断扩大,通过LoRA获得强大的性能需要增加rank k,与完全微调相比减少了计算节省。

在RoSA之前,LoRA代表了PEFT方法中最先进的技术,只是使用不同的矩阵分解或添加少量额外的微调参数等技术进行了适度的改进。

Robust Adaptation (RoSA)

Robust Adaptation(RoSA)引入了一种新的参数高效微调方法。RoSA的灵感来自于稳健的主成分分析(robust PCA),而不是仅仅依赖于低秩结构。

在传统的主成分分析中,数据矩阵X被分解为X≈L + S,其中L是一个近似主成分的低秩矩阵,S是一个捕获残差的稀疏矩阵。robust PCA更进一步,将X分解为干净的低秩L和“污染/损坏”的稀疏S。

RoSA从中汲取灵感,将语言模型的微调分解为:

一个类似于LoRA的低秩自适应(L)矩阵,经过微调以近似于主导任务相关信号

一个高度稀疏的微调(S)矩阵,包含非常少量的大的、选择性微调的参数,这些参数编码L错过的残差信号。

显式地建模残差稀疏分量可以使RoSA比单独的LoRA达到更高的精度。

RoSA通过对模型的头部矩阵进行低秩分解来构建L。这将编码对下游任务有用的底层语义表示。然后RoSA选择性地将每层最重要的前m个参数微调为S,而所有其他参数保持不变。这个步骤会捕获不适合低秩拟合的残差信号。

微调参数的数量m比LoRA单独所需的rank k要小一个数量级。因此结合L中的低秩头矩阵,RoSA保持了极高的参数效率。

RoSA还采用了一些其他简单但有效果的优化:

残差稀疏连接:在每个transformer块的输出经过层归一化和前馈子层之前,直接向其添加S个残差。这可以模拟L错过的信号。

独立稀疏掩码:S中选择的用于微调的指标是为每个transformer层独立生成的。

共享低秩结构:在L的所有层之间共享相同的低秩基U,V矩阵,就像在LoRA中一样。这将捕获一致子空间中的语义概念。

这些架构选择为RoSA建模提供了类似于完全微调的灵活性,同时保持了优化和推理的参数效率。利用这种结合鲁棒低秩自适应和高度稀疏残差的PEFT方法,RoSA实现了精度效率折衷的新技术。

实验与结果

研究人员在12个NLU数据集的综合基准上对RoSA进行了评估,这些数据集涵盖了文本检测、情感分析、自然语言推理和鲁棒性测试等任务。他们使用基于人工智能助理LLM的RoSA进行了实验,使用了120亿个参数模型。

在每个任务上,在使用相同的参数时,RoSA的性能都明显优于LoRA。两种方法的总参数都差不多为整个模型的0.3%左右。这意味着LoRA的k = 16, RoSA的m =5120这两种情况下都有大约450万个微调参数。

RoSA还匹配或超过了纯稀疏微调基线的性能。

在评估对对抗示例的鲁棒性的ANLI基准上,RoSA的得分为55.6,而LoRA的得分为52.7。这表明了泛化和校准的改进。

对于情感分析任务SST-2和IMDB, RoSA的准确率达到91.2%和96.9%,而LoRA的准确率为90.1%和95.3%。

在WIC(一项具有挑战性的词义消歧测试)上,RoSA的F1得分为93.5,而LoRA的F1得分为91.7。

在所有12个数据集中,RoSA在匹配的参数预算下普遍表现出比LoRA更好的性能。

值得注意的是,RoSA能够在不需要任何特定于任务的调优或专门化的情况下实现这些增益。这使得RoSA适合作为通用的PEFT解决方案使用。

总结

随着语言模型规模的持续快速增长,减少对其微调的计算需求是一个迫切需要解决的问题。像LoRA这样的参数高效自适应训练技术已经显示出初步的成功,但面临低秩近似的内在局限性。

RoSA将鲁棒低秩分解和残差高度稀疏微调有机地结合在一起,提供了一个令人信服的新解决方案。通过考虑通过选择性稀疏残差逃避低秩拟合的信号,它大大提高了PEFT的性能。经验评估表明,在不同的NLU任务集上,LoRA和不受控制的稀疏性基线有了明显的改进。

RoSA在概念上简单但高性能,能进一步推进参数效率、适应性表征和持续学习的交叉研究,以扩大语言智能。

以上是RoSA: 一种高效微调大模型参数的新方法的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

为什么大型语言模型都在使用 SwiGLU 作为激活函数?

Apr 08, 2024 pm 09:31 PM

为什么大型语言模型都在使用 SwiGLU 作为激活函数?

Apr 08, 2024 pm 09:31 PM

如果你一直在关注大型语言模型的架构,你可能会在最新的模型和研究论文中看到“SwiGLU”这个词。SwiGLU可以说是在大语言模型中最常用到的激活函数,我们本篇文章就来对它进行详细的介绍。SwiGLU其实是2020年谷歌提出的激活函数,它结合了SWISH和GLU两者的特点。SwiGLU的中文全称是“双向门控线性单元”,它将SWISH和GLU两种激活函数进行了优化和结合,以提高模型的非线性表达能力。SWISH是一种非常普遍的激活函数,它在大语言模型中得到广泛应用,而GLU则在自然语言处理任务中表现出

微调真的能让LLM学到新东西吗:引入新知识可能让模型产生更多的幻觉

Jun 11, 2024 pm 03:57 PM

微调真的能让LLM学到新东西吗:引入新知识可能让模型产生更多的幻觉

Jun 11, 2024 pm 03:57 PM

大型语言模型(LLM)是在巨大的文本数据库上训练的,在那里它们获得了大量的实际知识。这些知识嵌入到它们的参数中,然后可以在需要时使用。这些模型的知识在训练结束时被“具体化”。在预训练结束时,模型实际上停止学习。对模型进行对齐或进行指令调优,让模型学习如何充分利用这些知识,以及如何更自然地响应用户的问题。但是有时模型知识是不够的,尽管模型可以通过RAG访问外部内容,但通过微调使用模型适应新的领域被认为是有益的。这种微调是使用人工标注者或其他llm创建的输入进行的,模型会遇到额外的实际知识并将其整合

一文搞懂Tokenization!

Apr 12, 2024 pm 02:31 PM

一文搞懂Tokenization!

Apr 12, 2024 pm 02:31 PM

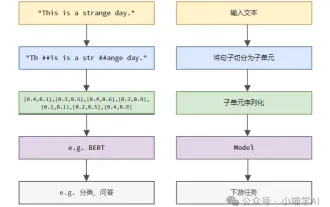

语言模型是对文本进行推理的,文本通常是字符串形式,但模型的输入只能是数字,因此需要将文本转换成数字形式。Tokenization是自然语言处理的基本任务,根据特定需求能够把一段连续的文本序列(如句子、段落等)切分为一个字符序列(如单词、短语、字符、标点等多个单元),其中的单元称为token或词语。根据下图所示的具体流程,首先将文本句子切分成一个个单元,然后将单元素数值化(映射为向量),再将这些向量输入到模型进行编码,最后输出到下游任务进一步得到最终的结果。文本切分按照文本切分的粒度可以将Toke

可视化FAISS矢量空间并调整RAG参数提高结果精度

Mar 01, 2024 pm 09:16 PM

可视化FAISS矢量空间并调整RAG参数提高结果精度

Mar 01, 2024 pm 09:16 PM

随着开源大型语言模型的性能不断提高,编写和分析代码、推荐、文本摘要和问答(QA)对的性能都有了很大的提高。但是当涉及到QA时,LLM通常会在未训练数据的相关的问题上有所欠缺,很多内部文件都保存在公司内部,以确保合规性、商业秘密或隐私。当查询这些文件时,会使得LLM产生幻觉,产生不相关、捏造或不一致的内容。一种处理这一挑战的可行技术是检索增强生成(RAG)。它涉及通过引用训练数据源之外的权威知识库来增强响应的过程,以提升生成的质量和准确性。RAG系统包括一个检索系统,用于从语料库中检索相关文档片段

使用SPIN技术进行自我博弈微调训练的LLM的优化

Jan 25, 2024 pm 12:21 PM

使用SPIN技术进行自我博弈微调训练的LLM的优化

Jan 25, 2024 pm 12:21 PM

2024年是大型语言模型(LLM)迅速发展的一年。在LLM的训练中,对齐方法是一个重要的技术手段,其中包括监督微调(SFT)和依赖人类偏好的人类反馈强化学习(RLHF)。这些方法在LLM的发展中起到了至关重要的作用,但是对齐方法需要大量的人工注释数据。面对这一挑战,微调成为一个充满活力的研究领域,研究人员积极致力于开发能够有效利用人类数据的方法。因此,对齐方法的发展将推动LLM技术的进一步突破。加州大学最近进行了一项研究,介绍了一种名为SPIN(SelfPlayfInetuNing)的新技术。S

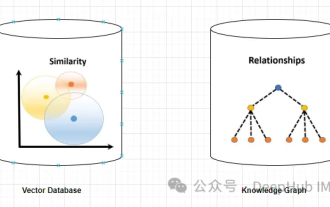

利用知识图谱增强RAG模型的能力和减轻大模型虚假印象

Jan 14, 2024 pm 06:30 PM

利用知识图谱增强RAG模型的能力和减轻大模型虚假印象

Jan 14, 2024 pm 06:30 PM

在使用大型语言模型(LLM)时,幻觉是一个常见问题。尽管LLM可以生成流畅连贯的文本,但其生成的信息往往不准确或不一致。为了防止LLM产生幻觉,可以利用外部的知识来源,比如数据库或知识图谱,来提供事实信息。这样一来,LLM可以依赖这些可靠的数据源,从而生成更准确和可靠的文本内容。向量数据库和知识图谱向量数据库向量数据库是一组表示实体或概念的高维向量。它们可以用于度量不同实体或概念之间的相似性或相关性,通过它们的向量表示进行计算。一个向量数据库可以根据向量距离告诉你,“巴黎”和“法国”比“巴黎”和

云端部署大模型的三个秘密

Apr 24, 2024 pm 03:00 PM

云端部署大模型的三个秘密

Apr 24, 2024 pm 03:00 PM

编译|星璇出品|51CTO技术栈(微信号:blog51cto)在过去的两年里,我更多地参与了使用大型语言模型(LLMs)的生成AI项目,而非传统的系统。我开始怀念无服务器云计算。它们的应用范围广泛,从增强对话AI到为各行各业提供复杂的分析解决方案,以及其他许多功能。许多企业将这些模型部署在云平台上,因为公共云提供商已经提供了现成的生态系统,而且这是阻力最小的路径。然而,这并不便宜。云还提供了其他好处,如可扩展性、效率和高级计算能力(按需提供GPU)。在公共云平台上部署LLM的过程有一些鲜为人知的

为大模型提供全新科学复杂问答基准与测评体系,UNSW、阿贡、芝加哥大学等多家机构联合推出SciQAG框架

Jul 25, 2024 am 06:42 AM

为大模型提供全新科学复杂问答基准与测评体系,UNSW、阿贡、芝加哥大学等多家机构联合推出SciQAG框架

Jul 25, 2024 am 06:42 AM

编辑|ScienceAI问答(QA)数据集在推动自然语言处理(NLP)研究发挥着至关重要的作用。高质量QA数据集不仅可以用于微调模型,也可以有效评估大语言模型(LLM)的能力,尤其是针对科学知识的理解和推理能力。尽管当前已有许多科学QA数据集,涵盖了医学、化学、生物等领域,但这些数据集仍存在一些不足。其一,数据形式较为单一,大多数为多项选择题(multiple-choicequestions),它们易于进行评估,但限制了模型的答案选择范围,无法充分测试模型的科学问题解答能力。相比之下,开放式问答