Conformer模型的构建和特性

Conformer是一种基于自注意力机制的序列模型,它在语音识别、语言建模、机器翻译等任务中取得了出色的表现。与Transformer模型相似,Conformer模型结构也包含了多头自注意力层和前馈神经网络层。然而,Conformer在一些方面进行了改进,使得它更适用于序列建模任务。 Conformer模型的一个改进是引入了卷积神经网络层,用于捕捉局部上下文信息。这种结构的引入使得模型能够更好地处理序列中的局部特征,提高了模型的泛化能力。 此外,Conformer还引入了一种新的位置编码方式,称为深度可分离卷积位置编码。相比于传统的位置编码方式,深度可分离卷积位置编码可以更好地捕捉序列中的位置信息,提高了模型对序列顺序的建模能力。 总之,

基本结构

Conformer模型的基本结构由多个Conformer Block组成。每个Conformer Block包含两个子模块:多头自注意力模块和卷积模块。多头自注意力模块用于捕捉序列中不同位置之间的交互信息,通过计算注意力权重来加强重要位置的表示。而卷积模块则用于对序列进行局部特征提取,通过卷积操作来捕捉局部上下文信息。这两个子模块相互结合,使得Conformer模型能够同时考虑全局和局部信息,从而有效地建模序列数据。

多头自注意力模块通过改进Transformer模型的注意力机制实现,具体改进包括相对位置编码和位置无关的信息交互方式。相对位置编码能够更好地处理序列中的位置信息,而位置无关的信息交互方式则适用于长序列的处理。这些改进使得多头自注意力模块在处理序列数据时具有更好的性能和效果。

卷积模块由深度可分离卷积层和残差连接组成,既减少了参数数量,又加速了训练和推理。残差连接缓解模型退化问题,加快收敛速度。

特点

与传统的序列模型相比,Conformer模型具有以下特点:

1.更好的序列建模能力

Conformer模型采用了多头自注意力机制,可以更好地捕捉序列中不同位置之间的交互信息。同时,它还采用了卷积模块,可以更好地进行局部特征提取。这些特点使得Conformer模型在序列建模任务中具有更好的性能。

2.更高的模型效率

Conformer模型采用了深度可分离卷积层和残差连接,可以有效地减少模型参数数量,并加速模型训练和推理过程。这些特点使得Conformer模型在实际应用中具有更高的效率。

3.更好的泛化能力

Conformer模型采用了相对位置编码和位置无关的信息交互方式,可以更好地处理长序列,并具有更好的泛化能力。这些特点使得Conformer模型在应对复杂任务时具有更好的适应性。

以上是Conformer模型的构建和特性的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

超越ORB-SLAM3!SL-SLAM:低光、严重抖动和弱纹理场景全搞定

May 30, 2024 am 09:35 AM

超越ORB-SLAM3!SL-SLAM:低光、严重抖动和弱纹理场景全搞定

May 30, 2024 am 09:35 AM

写在前面今天我们探讨下深度学习技术如何改善在复杂环境中基于视觉的SLAM(同时定位与地图构建)性能。通过将深度特征提取和深度匹配方法相结合,这里介绍了一种多功能的混合视觉SLAM系统,旨在提高在诸如低光条件、动态光照、弱纹理区域和严重抖动等挑战性场景中的适应性。我们的系统支持多种模式,包括拓展单目、立体、单目-惯性以及立体-惯性配置。除此之外,还分析了如何将视觉SLAM与深度学习方法相结合,以启发其他研究。通过在公共数据集和自采样数据上的广泛实验,展示了SL-SLAM在定位精度和跟踪鲁棒性方面优

一文搞懂:AI、机器学习与深度学习的联系与区别

Mar 02, 2024 am 11:19 AM

一文搞懂:AI、机器学习与深度学习的联系与区别

Mar 02, 2024 am 11:19 AM

在当今科技日新月异的浪潮中,人工智能(ArtificialIntelligence,AI)、机器学习(MachineLearning,ML)与深度学习(DeepLearning,DL)如同璀璨星辰,引领着信息技术的新浪潮。这三个词汇频繁出现在各种前沿讨论和实际应用中,但对于许多初涉此领域的探索者来说,它们的具体含义及相互之间的内在联系可能仍笼罩着一层神秘面纱。那让我们先来看看这张图。可以看出,深度学习、机器学习和人工智能之间存在着紧密的关联和递进关系。深度学习是机器学习的一个特定领域,而机器学习

超强!深度学习Top10算法!

Mar 15, 2024 pm 03:46 PM

超强!深度学习Top10算法!

Mar 15, 2024 pm 03:46 PM

自2006年深度学习概念被提出以来,20年快过去了,深度学习作为人工智能领域的一场革命,已经催生了许多具有影响力的算法。那么,你所认为深度学习的top10算法有哪些呢?以下是我心目中深度学习的顶尖算法,它们在创新性、应用价值和影响力方面都占据重要地位。1、深度神经网络(DNN)背景:深度神经网络(DNN)也叫多层感知机,是最普遍的深度学习算法,发明之初由于算力瓶颈而饱受质疑,直到近些年算力、数据的爆发才迎来突破。DNN是一种神经网络模型,它包含多个隐藏层。在该模型中,每一层将输入传递给下一层,并

利用双向LSTM模型进行文本分类的案例

Jan 24, 2024 am 10:36 AM

利用双向LSTM模型进行文本分类的案例

Jan 24, 2024 am 10:36 AM

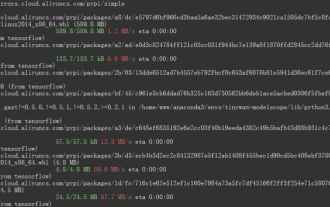

双向LSTM模型是一种用于文本分类的神经网络。以下是一个简单示例,演示如何使用双向LSTM进行文本分类任务。首先,我们需要导入所需的库和模块:importosimportnumpyasnpfromkeras.preprocessing.textimportTokenizerfromkeras.preprocessing.sequenceimportpad_sequencesfromkeras.modelsimportSequentialfromkeras.layersimportDense,Em

AlphaFold 3 重磅问世,全面预测蛋白质与所有生命分子相互作用及结构,准确性远超以往水平

Jul 16, 2024 am 12:08 AM

AlphaFold 3 重磅问世,全面预测蛋白质与所有生命分子相互作用及结构,准确性远超以往水平

Jul 16, 2024 am 12:08 AM

编辑|萝卜皮自2021年发布强大的AlphaFold2以来,科学家们一直在使用蛋白质结构预测模型来绘制细胞内各种蛋白质结构的图谱、发现药物,并绘制每种已知蛋白质相互作用的「宇宙图」 。就在刚刚,GoogleDeepMind发布了AlphaFold3模型,该模型能够对包括蛋白质、核酸、小分子、离子和修饰残基在内的复合物进行联合结构预测。 AlphaFold3的准确性对比过去许多专用工具(蛋白质-配体相互作用、蛋白质-核酸相互作用、抗体-抗原预测)有显着提高。这表明,在单个统一的深度学习框架内,可以实现

TensorFlow深度学习框架模型推理Pipeline进行人像抠图推理

Mar 26, 2024 pm 01:00 PM

TensorFlow深度学习框架模型推理Pipeline进行人像抠图推理

Mar 26, 2024 pm 01:00 PM

概述为了使ModelScope的用户能够快速、方便的使用平台提供的各类模型,提供了一套功能完备的Pythonlibrary,其中包含了ModelScope官方模型的实现,以及使用这些模型进行推理,finetune等任务所需的数据预处理,后处理,效果评估等功能相关的代码,同时也提供了简单易用的API,以及丰富的使用样例。通过调用library,用户可以只写短短的几行代码,就可以完成模型的推理、训练和评估等任务,也可以在此基础上快速进行二次开发,实现自己的创新想法。目前library提供的算法模型,

使用CNN和Transformer混合模型以提升性能的方法

Jan 24, 2024 am 10:33 AM

使用CNN和Transformer混合模型以提升性能的方法

Jan 24, 2024 am 10:33 AM

卷积神经网络(CNN)和Transformer是两种不同的深度学习模型,它们在不同的任务上都展现出了出色的表现。CNN主要用于计算机视觉任务,如图像分类、目标检测和图像分割等。它通过卷积操作在图像上提取局部特征,并通过池化操作进行特征降维和空间不变性。相比之下,Transformer主要用于自然语言处理(NLP)任务,如机器翻译、文本分类和语音识别等。它使用自注意力机制来建模序列中的依赖关系,避免了传统的循环神经网络中的顺序计算。尽管这两种模型用于不同的任务,但它们在序列建模方面有相似之处,因此

使用卷积神经网络进行图像降噪

Jan 23, 2024 pm 11:48 PM

使用卷积神经网络进行图像降噪

Jan 23, 2024 pm 11:48 PM

卷积神经网络在图像去噪任务中表现出色。它利用学习到的滤波器对噪声进行过滤,从而恢复原始图像。本文详细介绍了基于卷积神经网络的图像去噪方法。一、卷积神经网络概述卷积神经网络是一种深度学习算法,通过多个卷积层、池化层和全连接层的组合来进行图像特征学习和分类。在卷积层中,通过卷积操作提取图像的局部特征,从而捕捉到图像中的空间相关性。池化层则通过降低特征维度来减少计算量,并保留主要特征。全连接层负责将学习到的特征与标签进行映射,实现图像的分类或者其他任务。这种网络结构的设计使得卷积神经网络在图像处理和识