生成式AI能拯救电信行业吗?

在日前正在举办的MWC 2024大会上,英伟达发布了一系列公告,其中包括与ARM、ServiceNow和软银的合作,成立AI-RAN联盟,以及与挪威电信达成一项重大协议,该协议将使挪威电信获得英伟达最新的硬件和企业AI软件,以支持其运营中采用的许多人工智能用例。

探讨电信行业与生成式AI之间更广泛的关系

英伟达全球电信业务发展主管Chris Penrose在接受行业媒体采访时针对电信行业与生成式AI之间的更深层联系进行了深入研究。

当被问及电信行业面临的最大问题时,他说:“我想说的是,电信公司目前在5G方面进行了大量投资,但这并不一定转化为收入的显着提升。他们需要找到能够确保投资得到回报的方法。在早期,很多人对采用这一价值的杀手级应用程序感到兴奋,我认为我们现在实际上处于一个有趣的时刻,因为我相信生成式AI有潜力成为杀手级应用程序,而这一点正在显现。

因为现有的应用程序都将生成式AI作为其用户界面的一部分。现在确实是一个机会,无论是提供基础设施即服务,还是提供培训即服务、推理即服务,甚至是AI应用程序,都是由生成式AI驱动的全新机会。电信公司希望利用生成式AI,获得一些额外收入,使投资能够得到回报,并以他们都希望采用的方式利用5G基础设施。”

电信公司在生成式AI领域或无法成为核心力量

尽管许多电信公司希望在备受关注的生成式AI领域扮演重要角色,但它们未必是推动行动的核心。目前,生成式AI是谷歌、微软等大型科技公司的重点业务。

Penrose为此表示:“我们看到许多电信公司开始采取行动,因为这是下一波技术浪潮。很多国家和地区都在提出这一问题,'我们需要什么样的基础设施来推动AI进程?'这就是我们所说的在这些国家建立AI工厂或建立主权AI云的原因。

那么,人们是否开始看到越来越多的电信公司正在考虑如何在这个领域发挥作用?电信公司通常拥有并运营自己的数据中心,有足够空间和电力,这是用户真正需要的东西,而电信公司也知道如何运行大型基础设施项目。

这是一种非常特殊的构建类型,需要这样做才能真正解锁生成式AI。为了提高性能,需要采用数百个或数千个GPU,以便能够在AI模型上进行训练,这看起来不一定像标准部署。因此我们需要鼓励他们向前一步,这是电信公司必须做出的决定,他们必须要踏上这一旅程。电信公司有很多优势,例如与政府部门关系密切,与商业客户有良好的合作,他们是自己国家值得信赖的合作伙伴。那么,他们能够真正站在这波技术浪潮的前沿吗?”

以上是生成式AI能拯救电信行业吗?的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

字节跳动剪映推出 SVIP 超级会员:连续包年 499 元,提供多种 AI 功能

Jun 28, 2024 am 03:51 AM

字节跳动剪映推出 SVIP 超级会员:连续包年 499 元,提供多种 AI 功能

Jun 28, 2024 am 03:51 AM

本站6月27日消息,剪映是由字节跳动旗下脸萌科技开发的一款视频剪辑软件,依托于抖音平台且基本面向该平台用户制作短视频内容,并兼容iOS、安卓、Windows、MacOS等操作系统。剪映官方宣布会员体系升级,推出全新SVIP,包含多种AI黑科技,例如智能翻译、智能划重点、智能包装、数字人合成等。价格方面,剪映SVIP月费79元,年费599元(本站注:折合每月49.9元),连续包月则为59元每月,连续包年为499元每年(折合每月41.6元)。此外,剪映官方还表示,为提升用户体验,向已订阅了原版VIP

使用Rag和Sem-Rag提供上下文增强AI编码助手

Jun 10, 2024 am 11:08 AM

使用Rag和Sem-Rag提供上下文增强AI编码助手

Jun 10, 2024 am 11:08 AM

通过将检索增强生成和语义记忆纳入AI编码助手,提升开发人员的生产力、效率和准确性。译自EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG,作者JanakiramMSV。虽然基本AI编程助手自然有帮助,但由于依赖对软件语言和编写软件最常见模式的总体理解,因此常常无法提供最相关和正确的代码建议。这些编码助手生成的代码适合解决他们负责解决的问题,但通常不符合各个团队的编码标准、惯例和风格。这通常会导致需要修改或完善其建议,以便将代码接受到应

微调真的能让LLM学到新东西吗:引入新知识可能让模型产生更多的幻觉

Jun 11, 2024 pm 03:57 PM

微调真的能让LLM学到新东西吗:引入新知识可能让模型产生更多的幻觉

Jun 11, 2024 pm 03:57 PM

大型语言模型(LLM)是在巨大的文本数据库上训练的,在那里它们获得了大量的实际知识。这些知识嵌入到它们的参数中,然后可以在需要时使用。这些模型的知识在训练结束时被“具体化”。在预训练结束时,模型实际上停止学习。对模型进行对齐或进行指令调优,让模型学习如何充分利用这些知识,以及如何更自然地响应用户的问题。但是有时模型知识是不够的,尽管模型可以通过RAG访问外部内容,但通过微调使用模型适应新的领域被认为是有益的。这种微调是使用人工标注者或其他llm创建的输入进行的,模型会遇到额外的实际知识并将其整合

英伟达对话模型ChatQA进化到2.0版本,上下文长度提到128K

Jul 26, 2024 am 08:40 AM

英伟达对话模型ChatQA进化到2.0版本,上下文长度提到128K

Jul 26, 2024 am 08:40 AM

开放LLM社区正是百花齐放、竞相争鸣的时代,你能看到Llama-3-70B-Instruct、QWen2-72B-Instruct、Nemotron-4-340B-Instruct、Mixtral-8x22BInstruct-v0.1等许多表现优良的模型。但是,相比于以GPT-4-Turbo为代表的专有大模型,开放模型在很多领域依然还有明显差距。在通用模型之外,也有一些专精关键领域的开放模型已被开发出来,比如用于编程和数学的DeepSeek-Coder-V2、用于视觉-语言任务的InternVL

为大模型提供全新科学复杂问答基准与测评体系,UNSW、阿贡、芝加哥大学等多家机构联合推出SciQAG框架

Jul 25, 2024 am 06:42 AM

为大模型提供全新科学复杂问答基准与测评体系,UNSW、阿贡、芝加哥大学等多家机构联合推出SciQAG框架

Jul 25, 2024 am 06:42 AM

编辑|ScienceAI问答(QA)数据集在推动自然语言处理(NLP)研究发挥着至关重要的作用。高质量QA数据集不仅可以用于微调模型,也可以有效评估大语言模型(LLM)的能力,尤其是针对科学知识的理解和推理能力。尽管当前已有许多科学QA数据集,涵盖了医学、化学、生物等领域,但这些数据集仍存在一些不足。其一,数据形式较为单一,大多数为多项选择题(multiple-choicequestions),它们易于进行评估,但限制了模型的答案选择范围,无法充分测试模型的科学问题解答能力。相比之下,开放式问答

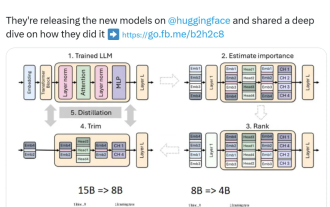

英伟达玩转剪枝、蒸馏:把Llama 3.1 8B参数减半,性能同尺寸更强

Aug 16, 2024 pm 04:42 PM

英伟达玩转剪枝、蒸馏:把Llama 3.1 8B参数减半,性能同尺寸更强

Aug 16, 2024 pm 04:42 PM

小模型崛起了。上个月,Meta发布了Llama3.1系列模型,其中包括Meta迄今为止最大的405B模型,以及两个较小的模型,参数量分别为700亿和80亿。Llama3.1被认为是引领了开源新时代。然而,新一代的模型虽然性能强大,但部署时仍需要大量计算资源。因此,业界出现了另一种趋势,即开发小型语言模型(SLM),这种模型在许多语言任务中表现足够出色,部署起来也非常便宜。最近,英伟达研究表明,结构化权重剪枝与知识蒸馏相结合,可以从初始较大的模型中逐步获得较小的语言模型。图灵奖得主、Meta首席A

符合英伟达 SFF-Ready 规范,华硕推出 Prime GeForce RTX 40 系列显卡

Jun 15, 2024 pm 04:38 PM

符合英伟达 SFF-Ready 规范,华硕推出 Prime GeForce RTX 40 系列显卡

Jun 15, 2024 pm 04:38 PM

本站6月15日消息,华硕最新推出了Prime系列GeForceRTX40系列“Ada”显卡,其尺寸符合英伟达最新SFF-Ready规范,该规范要求显卡尺寸不超过304毫米x151毫米x50毫米(长x高x厚)。华硕本次推出的Prime系列GeForceRTX40系列包括RTX4060Ti、RTX4070和RTX4070SUPER,不过目前并不包含RTX4070TiSUPER或RTX4080SUPER。该系列RTX40显卡采用常见电路板设计,尺寸为269毫米x120毫米x50毫米,三款显卡的区别主要

SOTA性能,厦大多模态蛋白质-配体亲和力预测AI方法,首次结合分子表面信息

Jul 17, 2024 pm 06:37 PM

SOTA性能,厦大多模态蛋白质-配体亲和力预测AI方法,首次结合分子表面信息

Jul 17, 2024 pm 06:37 PM

编辑|KX在药物研发领域,准确有效地预测蛋白质与配体的结合亲和力对于药物筛选和优化至关重要。然而,目前的研究没有考虑到分子表面信息在蛋白质-配体相互作用中的重要作用。基于此,来自厦门大学的研究人员提出了一种新颖的多模态特征提取(MFE)框架,该框架首次结合了蛋白质表面、3D结构和序列的信息,并使用交叉注意机制进行不同模态之间的特征对齐。实验结果表明,该方法在预测蛋白质-配体结合亲和力方面取得了最先进的性能。此外,消融研究证明了该框架内蛋白质表面信息和多模态特征对齐的有效性和必要性。相关研究以「S