Intel开源NPU加速库,酷睿Ultra处理器AI PC可运行轻量级大语言模型

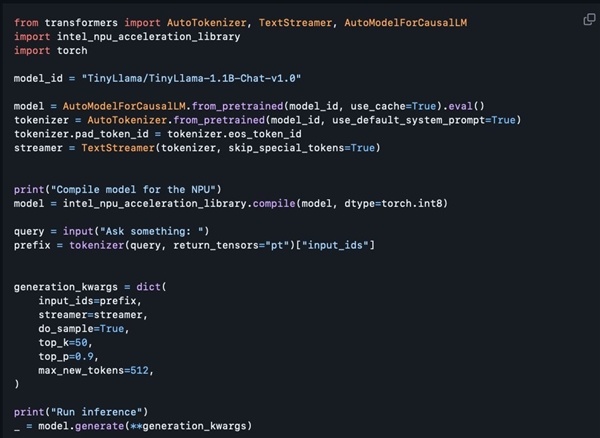

3月4日消息显示,Intel最近在GitHub上发布了其NPU加速库,这一举措使得搭载酷睿Ultra处理器的AI PC能够更加顺畅地运行诸如TinyLlama、Gemma-2b等轻量级大型语言模型。

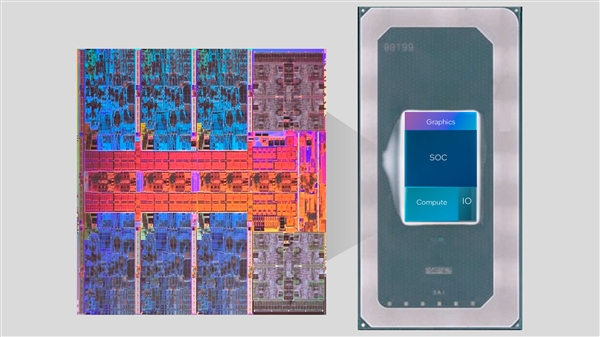

酷睿Ultra系列首次整合了NPU AI引擎,此引擎可处理一些轻量级的AI推理任务,并与CPU、GPU协同工作,以满足各种AI应用的要求。

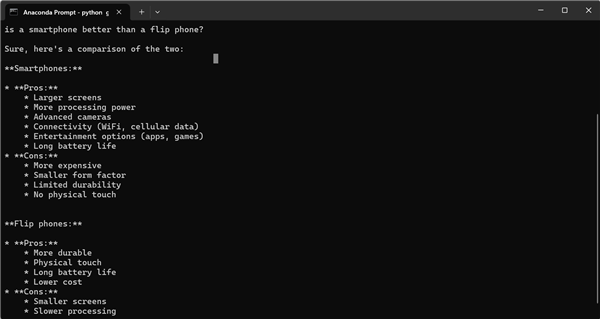

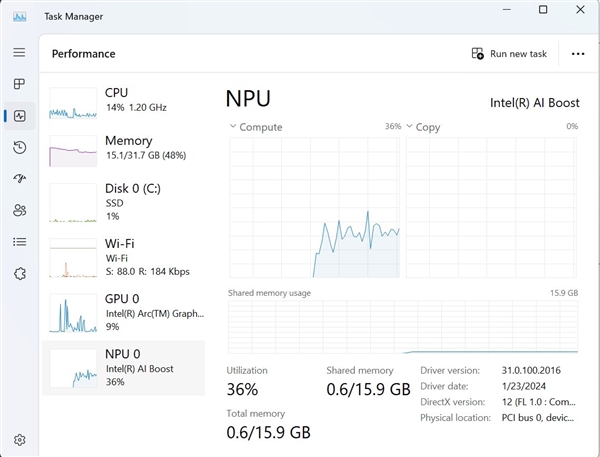

据了解,虽然这次发布的NPU加速库主要是为开发人员准备的,但那些有一定编程经验的用户同样可以尝试使用。Intel的软件架构师Tony Mongkolsmai演示了如何在微星尊爵14 AI Evo笔记本电脑上运行一个基于11亿参数的TinyLlama大模型的AI聊天机器人,这个机器人可以进行简单的对话。同时,Windows任务管理器也显示了NPU的有效调用。

然而,当前的开源NPU加速库在功能上还存在一些不足,它支持8比特量化和FP16精度,但尚不支持4比特量化、BF16精度以及NPU/GPU的混合计算等高级功能,且相关技术文档也尚未提供。不过,Intel已承诺将在后续逐步扩展其功能,预期将比现有功能增加一倍,这无疑将为AI开发者们带来更多的便利和可能性。

以上是Intel开源NPU加速库,酷睿Ultra处理器AI PC可运行轻量级大语言模型的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

泄漏揭示了英特尔 Arrow Lake-U、-H、-HX 和 -S 的关键规格

Jun 15, 2024 pm 09:49 PM

泄漏揭示了英特尔 Arrow Lake-U、-H、-HX 和 -S 的关键规格

Jun 15, 2024 pm 09:49 PM

英特尔ArrowLake预计将基于与LunarLake相同的处理器架构,这意味着英特尔全新的LionCove性能核心将与经济的Skymont效率核心相结合。而LunarLake仅作为ava推出

Beelink EQi12 推出,比 EQ12 更强大的迷你电脑

Aug 21, 2024 pm 08:37 PM

Beelink EQi12 推出,比 EQ12 更强大的迷你电脑

Aug 21, 2024 pm 08:37 PM

Beelink 推出了一款新的迷你电脑 EQi12。它是该品牌去年推出的EQ12的升级版,搭载Intel N100。较新的计算机最多可配备 Intel Core i7 12650H,这是更高端的芯片之一

LG 推出迄今为止最薄、最轻的 Intel Lunar Lake 笔记本电脑,搭载 LG Gram 16 Pro 更新

Sep 10, 2024 am 06:44 AM

LG 推出迄今为止最薄、最轻的 Intel Lunar Lake 笔记本电脑,搭载 LG Gram 16 Pro 更新

Sep 10, 2024 am 06:44 AM

LG 已经提供了配备 Intel Meteor Lake 处理器的 Gram 16 Pro(亚马逊售价 1,699.99 美元)。不过,该公司已决定将英特尔的 Meteor Lake 架构替换为 Lunar Lake,英特尔上周在柏林 IFA 2024 上展示了该架构。钍

Intel TXT是什么?

Jun 11, 2023 pm 06:57 PM

Intel TXT是什么?

Jun 11, 2023 pm 06:57 PM

IntelTXT是Intel公司推出的一种硬件辅助安全技术,它可以通过在CPU和BIOS间建立一个受保护的空间,来确保服务器在启动时的完整性和安全性。TXT的全称是TrustedExecutionTechnology,也就是可信执行技术。简单来说,TXT是一种安全技术,它可以提供硬件级别的保护,确保服务器在启动时没有被恶意程序或未经授权的软件修改。这一

Intel开源NPU加速库,酷睿Ultra处理器AI PC可运行轻量级大语言模型

Mar 05, 2024 am 11:13 AM

Intel开源NPU加速库,酷睿Ultra处理器AI PC可运行轻量级大语言模型

Mar 05, 2024 am 11:13 AM

3月4日消息显示,Intel最近在GitHub上发布了其NPU加速库,这一举措使得搭载酷睿Ultra处理器的AIPC能够更加顺畅地运行诸如TinyLlama、Gemma-2b等轻量级大型语言模型。酷睿Ultra系列首次整合了NPUAI引擎,此引擎可处理一些轻量级的AI推理任务,并与CPU、GPU协同工作,以满足各种AI应用的要求。据了解,虽然这次发布的NPU加速库主要是为开发人员准备的,但那些有一定编程经验的用户同样可以尝试使用。Intel的软件架构师TonyMongkolsmai演示了如何在微

Yoga Slim 7i Aura Edition:联想推出新款轻量级英特尔 Lunar Lake 笔记本电脑,击败三星

Sep 11, 2024 am 06:41 AM

Yoga Slim 7i Aura Edition:联想推出新款轻量级英特尔 Lunar Lake 笔记本电脑,击败三星

Sep 11, 2024 am 06:41 AM

联想现已发布 Yoga Slim 7i Aura 版,距离最初推出基于 Intel Lunar Lake 的笔记本电脑不到一周。请注意,虽然该公司在柏林 IFA 2024 期间透露了有关这款笔记本电脑的大量细节,但它还是选择了

Arc Battlemage:泄露暗示英特尔下一代游戏显卡将配备三款 GPU

Jul 02, 2024 am 09:44 AM

Arc Battlemage:泄露暗示英特尔下一代游戏显卡将配备三款 GPU

Jul 02, 2024 am 09:44 AM

英特尔下一代 GPU 架构预计将于 9 月推出,作为英特尔 Lunar Lake 的一部分。与 Meteor Lake 的 Arc Alchemist iGPU 一样,该 iGPU 拥有多达 8 个 Xe 核心,但新架构预计可实现 50% 的性能提升

IFA 2024 | Lenovo ThinkPad X1 Carbon Gen 13 Aura Edition:联想首款 Lunar Lake ThinkPad 几乎与 X1 Nano 一样轻

Sep 06, 2024 am 06:50 AM

IFA 2024 | Lenovo ThinkPad X1 Carbon Gen 13 Aura Edition:联想首款 Lunar Lake ThinkPad 几乎与 X1 Nano 一样轻

Sep 06, 2024 am 06:50 AM

众所周知,十三是严重缺乏的。不过,迷信在科技行业并不是一种美德。对于联想来说,第 13 代高端笔记本电脑似乎注定会像前 12 代笔记本电脑一样成功。在最大的 PC 制造商 IFA