惊艳!!!特斯拉端到端演示视频分析

外网有用户放了一段特斯拉FSD v12的视频,有人搬运到b站上了:

https://www.bilibili.com/video/BV1Z6421M797www.bilibili.com/video/BV1Z6421M797

这次恰好是一个纯视觉方面较为复杂的场景:下雨天地面积水,水面上反射出各种图案,可能会产生一些奇异的视觉效果。特斯拉去年没有举办ai day活动,据称是因为竞争对手经常挑拨他们的幻灯片,所以干脆取消了。在缺乏详细信息的情况下,观察视频可以略窥一些端到端的特性。接下来,让我们针对其中一些有趣的地方进行分析。

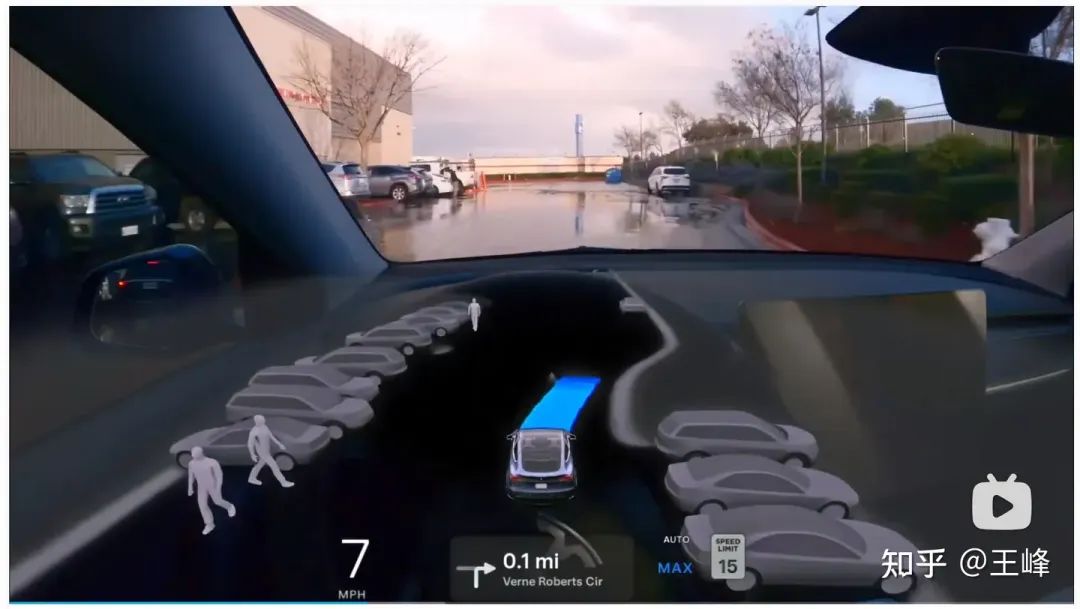

01:57,误检车门打开,大幅度绕行:

这里倒是问题不大,左侧有比较大的空间,所以多绕一点也无所谓了。

02:09,误检occ导致几乎刹停:

行人已经离开,我们可以开始前行了。然而,地面上有很多积水,反射着物体的影像,这可能导致误检测,所以我们又停下来等了一会儿才继续前行。

04:40,近距离cutin车辆漏检

这里左侧非常近距离的倒车cut-in车辆漏检了,但planning似乎并没有给出起步的意图,这里体现出了端到端的一大优势:上游出错的结果并不一定会导致错误的驾驶行为,后面我们还会看到更多类似的例子。

05:37 误检occ

这里可能也是地面积水产生的occ吧,端到端采信了这个结果,左右乱打方向盘,一会向左一会向右。

05:48,左右近距离occ误检

在左右非常近的位置出现了occ误检,如果还是按规则来写可能就得报接管了(也不一定,毕竟没有在行驶轨迹上),这里端到端直接无视了这两坨occ,继续开。

06:57,正前方近距离行人误检

这个是真的牛逼,脸上刷出来一个行人,所有基于规则的规控此时一定会急刹+警报了,但端到端模型并不认可上游的结果,照常行驶。

14分:在一个私人停车场里打转出不去了

这里可能是BEV的感知距离不够的问题,迟迟没有找到出口,在一个停车场里打转。。

其他的片段就都是主路上行驶了,到了主路上FSD v12的表现很丝滑,没有什么大问题,尤其是夜晚看车道线的检测也是非常稳定的,不过我觉得大部分厂家也能做到这样的水平,就不多提了。

单看停车场这一段,如果不看上游的结果的话,除了那个正前方occ误检导致左右乱打方向盘,FSD v12的轨迹还是比较丝滑的,即使有错误也没有被卡住的情况。在这样一个有行人、有不规则移动障碍物(手推车)、地面有积水的场景中表现也确实还可以。

特斯拉使用的还是有中间模块监督的多任务端到端,所以前端仍然可以显示出来obj det和occ的结果。但是端到端里的规控并不一定会采信上游的结果,近距离漏检了不一定会起步撞车,近距离误检了也不一定会刹停,所有的结果都输入到pnc里综合判断。这确实是比较有意思的一点,可以确定的是马斯克并没有说谎,这的确是一个端到端系统才会有的表现。

以上是惊艳!!!特斯拉端到端演示视频分析的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

自动驾驶场景中的长尾问题怎么解决?

Jun 02, 2024 pm 02:44 PM

自动驾驶场景中的长尾问题怎么解决?

Jun 02, 2024 pm 02:44 PM

昨天面试被问到了是否做过长尾相关的问题,所以就想着简单总结一下。自动驾驶长尾问题是指自动驾驶汽车中的边缘情况,即发生概率较低的可能场景。感知的长尾问题是当前限制单车智能自动驾驶车辆运行设计域的主要原因之一。自动驾驶的底层架构和大部分技术问题已经被解决,剩下的5%的长尾问题,逐渐成了制约自动驾驶发展的关键。这些问题包括各种零碎的场景、极端的情况和无法预测的人类行为。自动驾驶中的边缘场景"长尾"是指自动驾驶汽车(AV)中的边缘情况,边缘情况是发生概率较低的可能场景。这些罕见的事件

nuScenes最新SOTA | SparseAD:稀疏查询助力高效端到端自动驾驶!

Apr 17, 2024 pm 06:22 PM

nuScenes最新SOTA | SparseAD:稀疏查询助力高效端到端自动驾驶!

Apr 17, 2024 pm 06:22 PM

写在前面&出发点端到端的范式使用统一的框架在自动驾驶系统中实现多任务。尽管这种范式具有简单性和清晰性,但端到端的自动驾驶方法在子任务上的性能仍然远远落后于单任务方法。同时,先前端到端方法中广泛使用的密集鸟瞰图(BEV)特征使得扩展到更多模态或任务变得困难。这里提出了一种稀疏查找为中心的端到端自动驾驶范式(SparseAD),其中稀疏查找完全代表整个驾驶场景,包括空间、时间和任务,无需任何密集的BEV表示。具体来说,设计了一个统一的稀疏架构,用于包括检测、跟踪和在线地图绘制在内的任务感知。此外,重

聊聊端到端与下一代自动驾驶系统,以及端到端自动驾驶的一些误区?

Apr 15, 2024 pm 04:13 PM

聊聊端到端与下一代自动驾驶系统,以及端到端自动驾驶的一些误区?

Apr 15, 2024 pm 04:13 PM

最近一个月由于众所周知的一些原因,非常密集地和行业内的各种老师同学进行了交流。交流中必不可免的一个话题自然是端到端与火爆的特斯拉FSDV12。想借此机会,整理一下在当下这个时刻的一些想法和观点,供大家参考和讨论。如何定义端到端的自动驾驶系统,应该期望端到端解决什么问题?按照最传统的定义,端到端的系统指的是一套系统,输入传感器的原始信息,直接输出任务关心的变量。例如,在图像识别中,CNN相对于传统的特征提取器+分类器的方法就可以称之为端到端。在自动驾驶任务中,输入各种传感器的数据(相机/LiDAR

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

FisheyeDetNet:首个基于鱼眼相机的目标检测算法

Apr 26, 2024 am 11:37 AM

目标检测在自动驾驶系统当中是一个比较成熟的问题,其中行人检测是最早得以部署算法之一。在多数论文当中已经进行了非常全面的研究。然而,利用鱼眼相机进行环视的距离感知相对来说研究较少。由于径向畸变大,标准的边界框表示在鱼眼相机当中很难实施。为了缓解上述描述,我们探索了扩展边界框、椭圆、通用多边形设计为极坐标/角度表示,并定义一个实例分割mIOU度量来分析这些表示。所提出的具有多边形形状的模型fisheyeDetNet优于其他模型,并同时在用于自动驾驶的Valeo鱼眼相机数据集上实现了49.5%的mAP

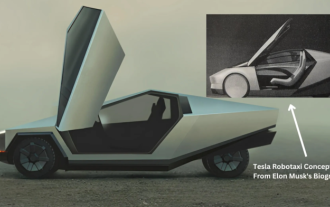

特斯拉终于出手了!无人自动驾驶出租车即将亮相?!

Apr 08, 2024 pm 05:49 PM

特斯拉终于出手了!无人自动驾驶出租车即将亮相?!

Apr 08, 2024 pm 05:49 PM

4月8日消息,特斯拉首席执行官埃隆·马斯克近日透露,特斯拉正致力于全力开发自动驾驶汽车技术,备受期待的无人自动驾驶出租车Robotaxi将于8月8日正式亮相。数据小编了解到,马斯克在X上的这一表态迅速引发了市场的广泛关注,特斯拉股价在盘后交易中应声上涨,达到171.19美元,涨幅超过3%。此前,路透社曾报道称特斯拉拉车的计划,将专注于生产Robotaxi。然而,马斯克对此进行了反驳,指责路透社已经取消了开发低成本汽车的计划,并再次发布了不实报道,同时明确表示低成本汽车Model2和Robotax

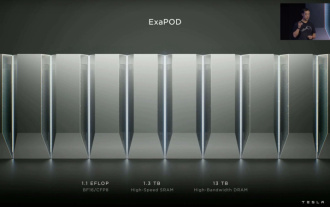

特斯拉 Dojo 超算首秀,马斯克:年底前训练 AI 算力约等于 8000 片英伟达 H100 GPU

Jul 24, 2024 am 10:38 AM

特斯拉 Dojo 超算首秀,马斯克:年底前训练 AI 算力约等于 8000 片英伟达 H100 GPU

Jul 24, 2024 am 10:38 AM

本站7月24日消息,特斯拉首席执行官埃隆・马斯克(ElonMusk)在今天举办的财报电话会议中,表示该公司即将完成迄今为止最大的人工智能训练集群,该集群将配备2万片英伟达公司H100GPU。马斯克还在公司财报电话会议上告诉投资者,由于来自英伟达公司的GPU价格昂贵,特斯拉公司将努力开发其Dojo超级计算机。本站翻译马斯克部分演讲内容如下:通过Dojo和英伟达竞争的道路很艰难,但我认为我们别无选择,我们现在过度依赖英伟达了。站在英伟达公司的角度,它们必然会将GPU的价格提高到市场所能承受的水平,但

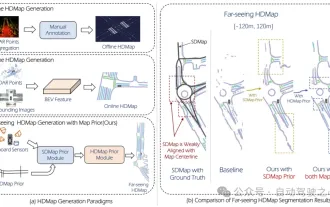

量产杀器!P-Mapnet:利用低精地图SDMap先验,建图性能暴力提升近20个点!

Mar 28, 2024 pm 02:36 PM

量产杀器!P-Mapnet:利用低精地图SDMap先验,建图性能暴力提升近20个点!

Mar 28, 2024 pm 02:36 PM

写在前面当前自动驾驶系统摆脱对高精度地图依赖的算法之一,是利用远距离范围下的感知表现依然较差的现实依然较差。为此,我们提出了P-MapNet,其中的“P”专注于融合地图先验来提高模型性能。具体来说,我们利用了SDMap和HDMap中的先验信息:一方面,我们从OpenStreetMap中提取了弱对准的SDMap数据,并将其编码为独立的条款来支持输入。严格修改输入与实际HD+Map存在弱对齐的问题,我们基于Cross-attention机制的结构能够自适应地关注SDMap骨架,并带来显着的性能提升;

LLM全搞定!OmniDrive:集3D感知、推理规划于一体(英伟达最新)

May 09, 2024 pm 04:55 PM

LLM全搞定!OmniDrive:集3D感知、推理规划于一体(英伟达最新)

May 09, 2024 pm 04:55 PM

写在前面&笔者的个人理解这篇论文致力于解决当前多模态大语言模型(MLLMs)在自动驾驶应用中存在的关键挑战,即将MLLMs从2D理解扩展到3D空间的问题。由于自动驾驶车辆(AVs)需要针对3D环境做出准确的决策,这一扩展显得尤为重要。3D空间理解对于AV来说至关重要,因为它直接影响车辆做出明智决策、预测未来状态以及与环境安全互动的能力。当前的多模态大语言模型(如LLaVA-1.5)通常仅能处理较低分辨率的图像输入(例如),这是由于视觉编码器的分辨率限制,LLM序列长度的限制。然而,自动驾驶应用需