扩散模型如何构建新一代决策智能体?超越自回归,同时生成长序列规划轨迹

设想一下,当你站在房间内,准备向门口走去,你是通过自回归的方式逐步规划路径吗?实际上,你的路径是一次性整体生成的。

最新研究指出,利用扩散模型的规划模块可以同时生成长序列的轨迹规划,更符合人类的决策方式。此外,扩散模型在策略表征和数据合成方面还能为现有的决策智能算法提供更为优化的方案。

来自上海交通大学的团队撰写的综述论文《Diffusion Models for Reinforcement Learning: A Survey》梳理了扩散模型在强化学习相关领域的应用。综述指出现有强化学习算法面临长序列规划误差累积、策略表达能力受限、交互数据不足等挑战,而扩散模型已经展现出解决强化学习问题中的优势,并为应对上述长期以来的挑战带来新的思路。

论文链接:https://arxiv.org/abs/2311.01223

项目地址:https://github.com/apexrl/Diff4RLSurvey

该综述对扩散模型在强化学习中的作用进行了分类,总结了不同强化学习场景中扩散模型的成功案例。最后,综述展望了未来利用扩散模型解决强化学习问题的发展方向。

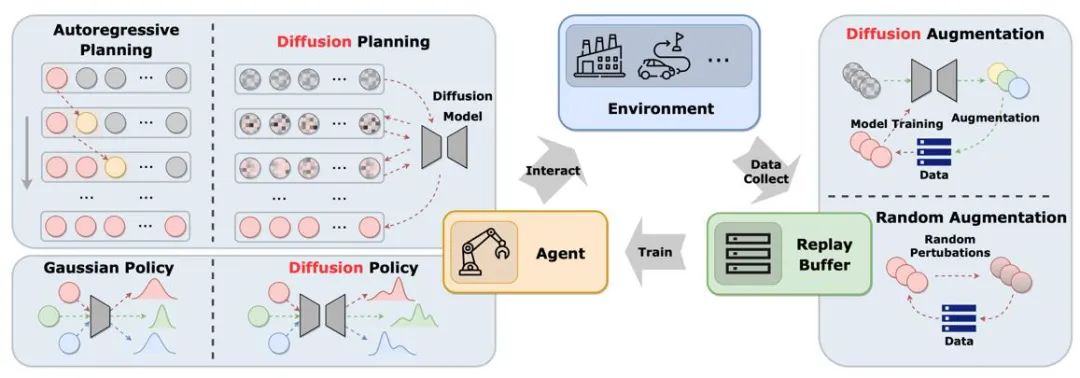

图中展示了扩散模型在经典智能体-环境-经验回放池循环中的作用。与传统解决方案相比,扩散模型为系统引入了新的元素,提供了更全面的信息交互和学习机会。通过这种方式,智能体能够更好地适应环境变化,并且优化其决策

扩散模型在强化学习中扮演的角色

文章根据扩散模型在强化学习中扮演角色的不同,分类比较了扩散模型的应用方式和特点。

图 2:扩散模型在强化学习中扮演的不同角色。

轨迹规划

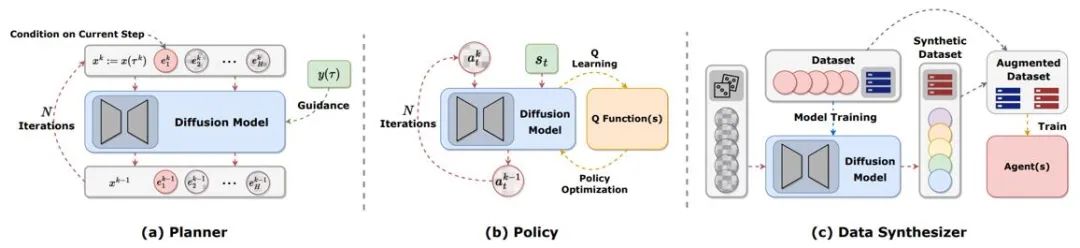

强化学习中的规划指通过使用动态模型在想象中做决策,再选择最大化累积奖励的适当动作。规划的过程通常会探索各种动作和状态的序列,从而提升决策的长期效果。在基于模型的强化学习(MBRL)框架中,规划序列通常以自回归方式进行模拟,导致累积误差。扩散模型可以同时生成多步规划序列。现有文章用扩散模型生成的目标非常多样,包括 (s,a,r)、(s,a)、仅有 s、仅有 a 等等。为了在在线评估时生成高奖励的轨迹,许多工作使用了有分类器或无分类器的引导采样技术。

策略表征

扩散规划器更近似传统强化学习中的 MBRL,与之相对,将扩散模型作为策略更类似于无模型强化学习。Diffusion-QL 首先将扩散策略与 Q 学习框架结合。由于扩散模型拟合多模态分布的能力远超传统模型,扩散策略在由多个行为策略采样的多模态数据集中表现良好。扩散策略与普通策略相同,通常以状态作为条件生成动作,同时考虑最大化 Q (s,a) 函数。Diffusion-QL 等方法在扩散模型训练时加上加权的价值函数项,而 CEP 从能量的视角构造加权回归目标,用价值函数作为因子,调整扩散模型学到的动作分布。

数据合成

扩散模型可以作为数据合成器,来缓解离线或在线强化学习中数据稀少的问题。传统强化学习数据增强方法通常只能对原有数据进行小幅扰动,而扩散模型强大的分布拟合能力使其可以直接学习整个数据集的分布,再采样出新的高质量数据。

其他类型

除了以上几类,还有一些零散的工作以其他方式使用扩散模型。例如,DVF 利用扩散模型估计值函数。LDCQ 首先将轨迹编码到隐空间上,再在隐空间上应用扩散模型。PolyGRAD 用扩散模型学习环境动态转移,允许策略和模型交互来提升策略学习效率。

在不同强化学习相关问题中的应用

离线强化学习

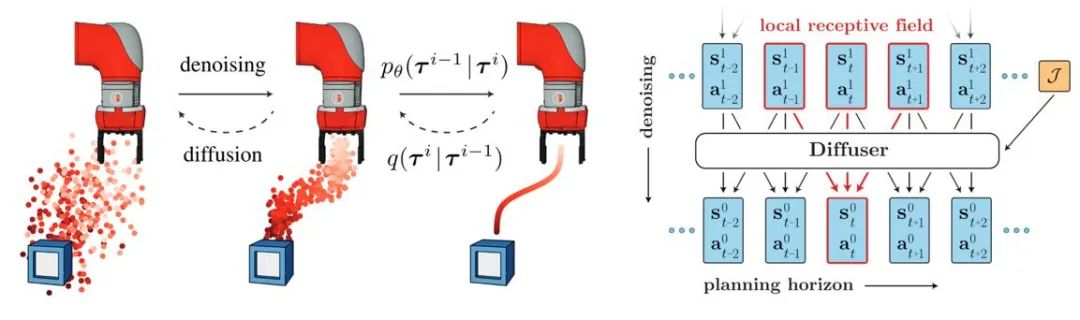

扩散模型的引入有助于离线强化学习策略拟合多模态数据分布并扩展了策略的表征能力。Diffuser 首先提出了基于分类器指导的高奖励轨迹生成算法并启发了大量的后续工作。同时,扩散模型也能应用在多任务与多智能体强化学习场景。

图 3:Diffuser 轨迹生成过程和模型示意图

在线强化学习

研究者证明扩散模型对在线强化学习中的价值函数、策略也具备优化能力。例如,DIPO 对动作数据重标注并使用扩散模型训练,使策略避免了基于价值引导训练的不稳定性;CPQL 则验证了单步采样扩散模型作为策略能够平衡交互时的探索和利用。

模仿学习

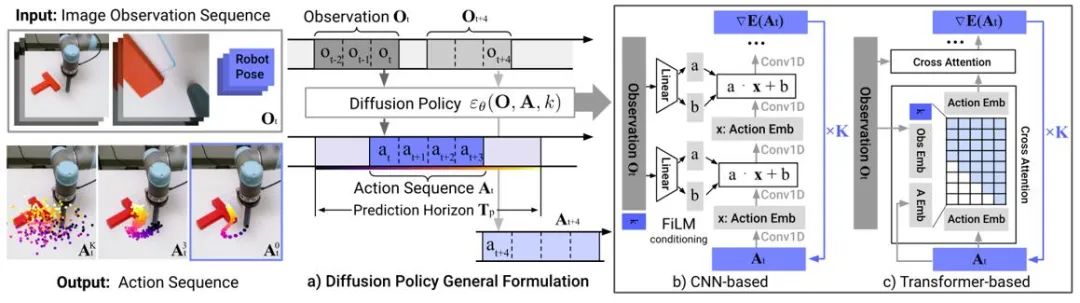

模仿学习通过学习专家演示数据来重建专家行为。扩散模型的应用有助于提高策略表征能力以及学习多样的任务技能。在机器人控制领域,研究发现扩散模型能够在保持时序稳定性的条件下预测闭环动作序列。Diffusion Policy 采用图像输入的扩散模型生成机器人动作序列。实验表明扩散模型能够生成有效闭环动作序列,同时保证时序一致性。

图 4:Diffusion Policy 模型示意图

轨迹生成

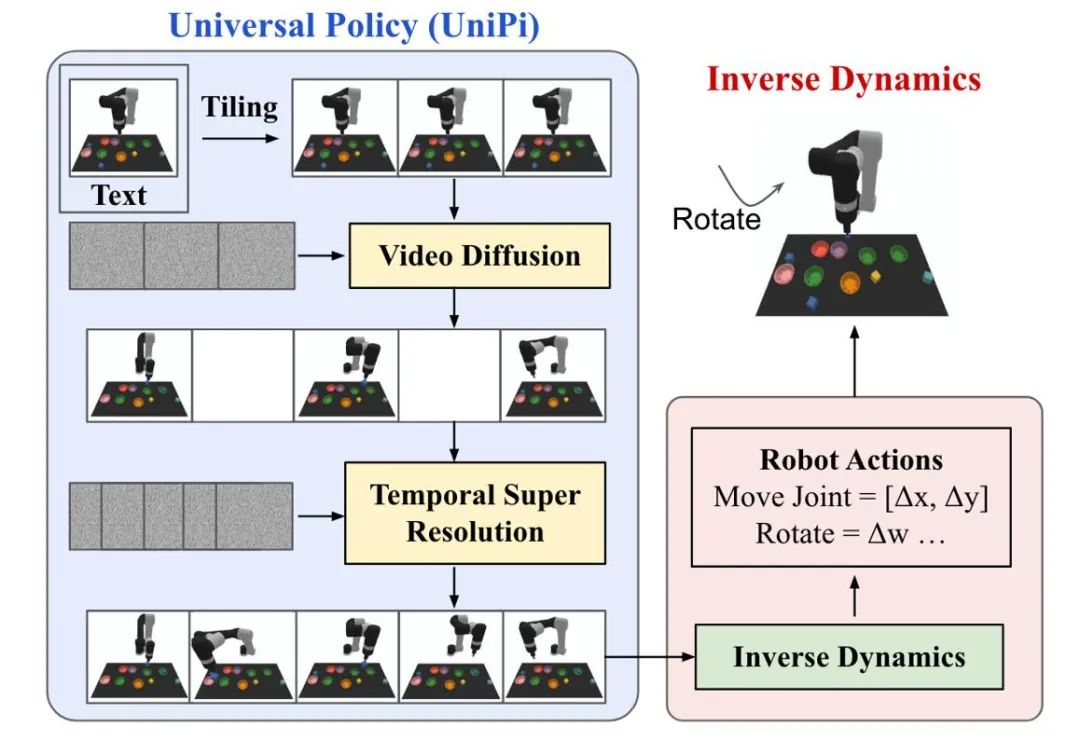

扩散模型在强化学习中的轨迹生成主要聚焦于人类动作生成以及机器人控制两类任务。扩散模型生成的动作数据或视频数据被用于构建仿真模拟器或训练下游决策模型。UniPi 训练了一个视频生成扩散模型作为通用策略,通过接入不同的逆动力学模型来得到底层控制命令,实现跨具身的机器人控制。

图 5:UniPi 决策过程示意图。

数据增强

扩散模型还可以直接拟合原始数据分布,在保持真实性的前提下提供多样的动态扩展数据。例如,SynthER 和 MTDiff-s 通过扩散模型生成了训练任务的完整环境转移信息并将其应用于策略的提升,且结果显示生成数据的多样程度以及准确性都优于历史方法。

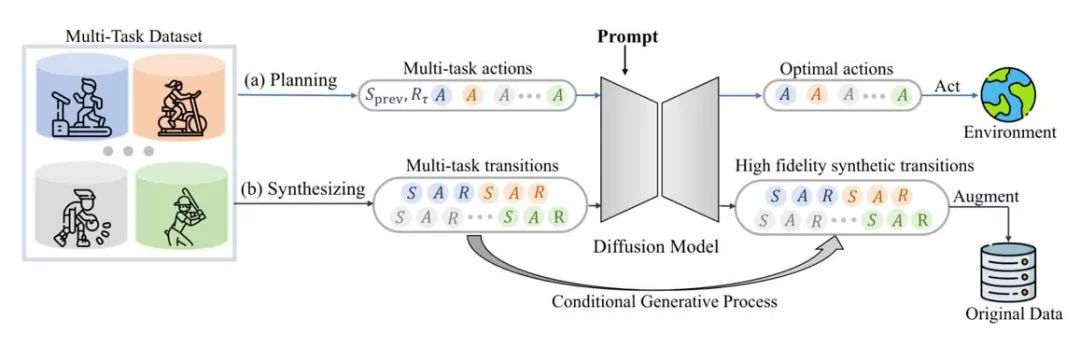

图 6:MTDiff 进行多任务规划和数据增强的示意图

未来展望

生成式仿真环境

如图 1 所示,现有研究主要利用扩散模型来克服智能体和经验回放池的局限性,利用扩散模型增强仿真环境的研究比较少。Gen2Sim 利用文生图扩散模型在模拟环境中生成多样化的可操作物体来提高机器人精密操作的泛化能力。扩散模型还有可能在仿真环境中生成状态转移函数、奖励函数或多智能体交互中的对手行为。

加入安全约束

通过将安全约束作为模型的采样条件,基于扩散模型的智能体可以做出满足特定约束的决策。扩散模型的引导采样允许通过学习额外的分类器来不断加入新的安全约束,而原模型的参数保持不变,从而节省额外的训练开销。

检索增强生成

检索增强生成技术能够通过访问外部数据集增强模型能力,在大语言模型上得到广泛的应用。通过检索与智能体当前状态相关的轨迹并输入到模型中,基于扩散的决策模型在这些状态下的性能同样可能得到提升。如果检索数据集不断更新,智能体有可能在不重新训练的情况下表现出新的行为。

组合多种技能

与分类器引导或无分类器引导相结合,扩散模型可以组合多种简单技能来完成复杂任务。离线强化学习中的早期结果也表明扩散模型可以共享不同技能之间的知识,从而有可能通过组合不同技能实现零样本迁移或持续学习。

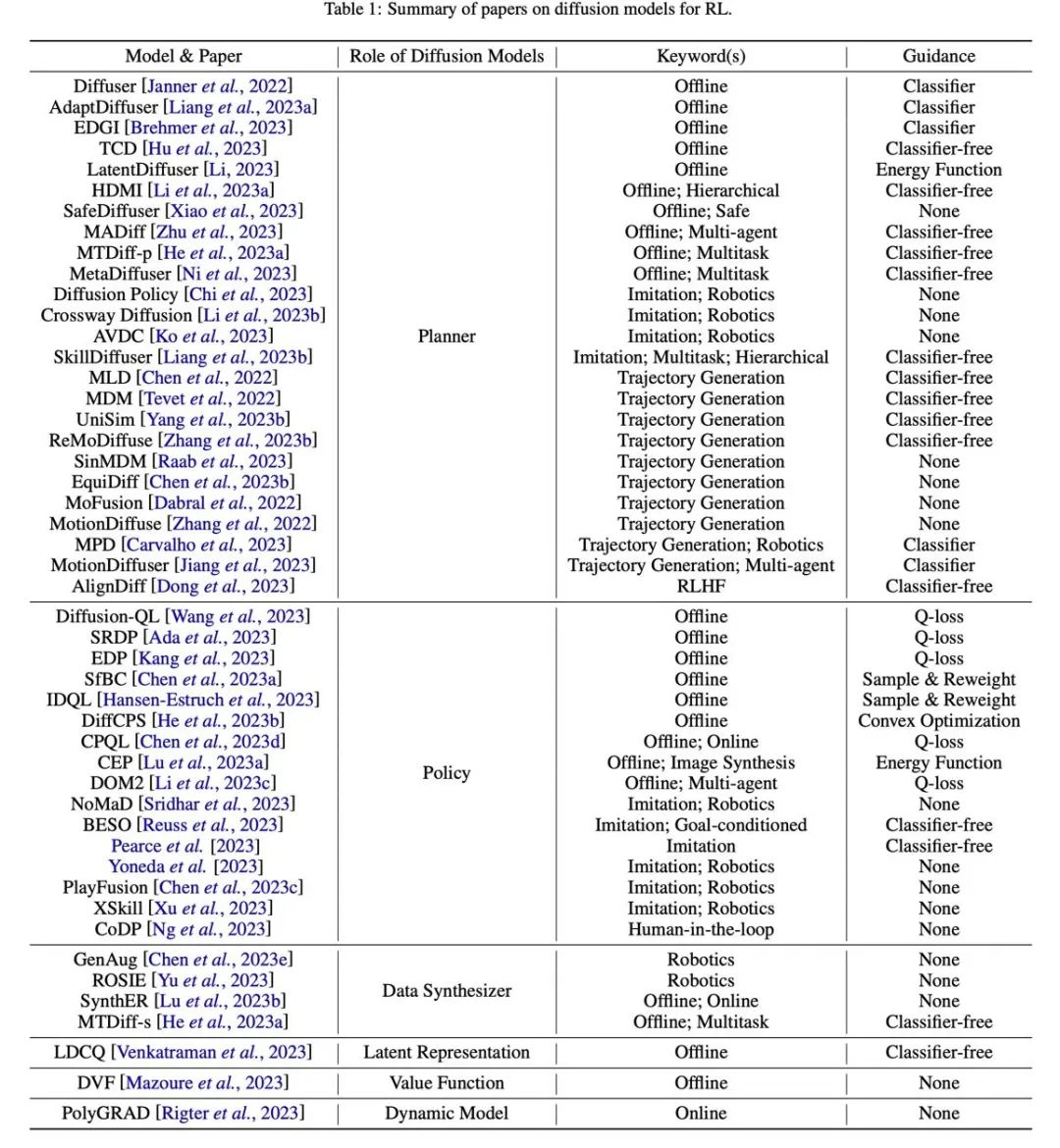

表格

图 7:相关论文汇总分类表格。

以上是扩散模型如何构建新一代决策智能体?超越自回归,同时生成长序列规划轨迹的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

joiplay模拟器使用方法介绍

May 04, 2024 pm 06:40 PM

joiplay模拟器使用方法介绍

May 04, 2024 pm 06:40 PM

jojplay模拟器是一款非常好用的手机模拟器,它支持电脑游戏可以在手机上运行,而且兼容性非常好,有些玩家不知道怎么使用,下面小编就为大家带来了使用方法介绍。joiplay模拟器怎么使用1、首先需要下载Joiplay本体及RPGM插件,最好按本体-插件的顺序进行安装,apk包可在Joiplay吧获取(点击获取>>>)。2、安卓完成后,就可以在左下角添加游戏了。3、name随便填,executablefile按CHOOSE选择游戏的game.exe文件。4、Icon可以留空也可以选择自己喜欢的图片

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

想象一下,一个人工智能模型,不仅拥有超越传统计算的能力,还能以更低的成本实现更高效的性能。这不是科幻,DeepSeek-V2[1],全球最强开源MoE模型来了。DeepSeek-V2是一个强大的专家混合(MoE)语言模型,具有训练经济、推理高效的特点。它由236B个参数组成,其中21B个参数用于激活每个标记。与DeepSeek67B相比,DeepSeek-V2性能更强,同时节省了42.5%的训练成本,减少了93.3%的KV缓存,最大生成吞吐量提高到5.76倍。DeepSeek是一家探索通用人工智

替代MLP的KAN,被开源项目扩展到卷积了

Jun 01, 2024 pm 10:03 PM

替代MLP的KAN,被开源项目扩展到卷积了

Jun 01, 2024 pm 10:03 PM

本月初,来自MIT等机构的研究者提出了一种非常有潜力的MLP替代方法——KAN。KAN在准确性和可解释性方面表现优于MLP。而且它能以非常少的参数量胜过以更大参数量运行的MLP。比如,作者表示,他们用KAN以更小的网络和更高的自动化程度重现了DeepMind的结果。具体来说,DeepMind的MLP有大约300,000个参数,而KAN只有约200个参数。KAN与MLP一样具有强大的数学基础,MLP基于通用逼近定理,而KAN基于Kolmogorov-Arnold表示定理。如下图所示,KAN在边上具

人生重开模拟器攻略大全

May 07, 2024 pm 05:28 PM

人生重开模拟器攻略大全

May 07, 2024 pm 05:28 PM

人生重开模拟器是一款非常有意思的模拟小游戏,这款游戏最近非常的火,游戏中有很多的玩法,下面小编就大家带来了人生重开模拟器攻略大全,快来看看都有哪些攻略吧。人生重开模拟器攻略大全人生重开模拟器特色这是一款非常有创造力的游戏,游戏里玩家可以根据自己的想法进行游戏。每天都会有许多的任务可以去完成,在这个虚拟的世界里享受全新的人生。游戏里拥有许多的歌曲,各种各样不一样的人生等候你来感受。人生重开模拟器游戏内容天赋抽卡:天赋:必选神秘的小盒子,才能修仙。各种各样的小胶囊可选,避免中途死掉。克苏鲁选了可能会

joiplay模拟器字体设置方法介绍

May 09, 2024 am 08:31 AM

joiplay模拟器字体设置方法介绍

May 09, 2024 am 08:31 AM

jojplay模拟器其实可以自定义游戏字体的,而且可以解决文字出现缺字、方框字的问题,想必不少玩家还不知道怎么操作,下面小编就为大家带来了joiplay模拟器字体设置方法介绍。joiplay模拟器字体怎么设置1、首先打开joiplay模拟器,点击右上角的设置(三个点),找到。2、在RPGMSettings一栏,第三行CustomFont自定义字体,点击选择。3、选择字体文件,点击ok就行了,注意不要按右下角“保存”图标,不然会原默认设置。4、推荐方正准圆简体(已在复兴、重生游戏文件夹内)。joi

雷电模拟器怎么删除应用?-雷电模拟器删除应用的方法?

May 08, 2024 pm 02:40 PM

雷电模拟器怎么删除应用?-雷电模拟器删除应用的方法?

May 08, 2024 pm 02:40 PM

雷电模拟器版本官方版是一款相当专业的安卓模拟器工具。那么雷电模拟器怎么删除应用?雷电模拟器删除应用的方法?下面就让小编给大家解答下吧!雷电模拟器怎么删除应用?1、点击并长按你想要删除的应用图标。2、等待一段时间,直到出现卸载或删除应用的选项。3、将应用拖到卸载选项处。4、在弹出的确认窗口中,点击确定就可以完成应用的删除。

特斯拉机器人进厂打工,马斯克:手的自由度今年将达到22个!

May 06, 2024 pm 04:13 PM

特斯拉机器人进厂打工,马斯克:手的自由度今年将达到22个!

May 06, 2024 pm 04:13 PM

特斯拉机器人Optimus最新视频出炉,已经可以在厂子里打工了。正常速度下,它分拣电池(特斯拉的4680电池)是这样的:官方还放出了20倍速下的样子——在小小的“工位”上,拣啊拣啊拣:这次放出的视频亮点之一在于Optimus在厂子里完成这项工作,是完全自主的,全程没有人为的干预。并且在Optimus的视角之下,它还可以把放歪了的电池重新捡起来放置,主打一个自动纠错:对于Optimus的手,英伟达科学家JimFan给出了高度的评价:Optimus的手是全球五指机器人里最灵巧的之一。它的手不仅有触觉

美国空军高调展示首个AI战斗机!部长亲自试驾全程未干预,10万行代码试飞21次

May 07, 2024 pm 05:00 PM

美国空军高调展示首个AI战斗机!部长亲自试驾全程未干预,10万行代码试飞21次

May 07, 2024 pm 05:00 PM

最近,军事圈被这个消息刷屏了:美军的战斗机,已经能由AI完成全自动空战了。是的,就在最近,美军的AI战斗机首次公开,揭开了神秘面纱。这架战斗机的全名是可变稳定性飞行模拟器测试飞机(VISTA),由美空军部长亲自搭乘,模拟了一对一的空战。5月2日,美国空军部长FrankKendall在Edwards空军基地驾驶X-62AVISTA升空注意,在一小时的飞行中,所有飞行动作都由AI自主完成!Kendall表示——在过去的几十年中,我们一直在思考自主空对空作战的无限潜力,但它始终显得遥不可及。然而如今,