8B文字多模态大模型指标逼近GPT4V,字节、华师、华科联合提出TextSquare

AIxiv专栏是本站发布学术、技术内容的栏目。 过去几年,本站AIxiv专栏接收报道道约2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道邮箱。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com。

近期,多模态大模型(MLLM)在文本中心的VQA领域取得了显着进展,尤其是多个闭源模型,例如:GPT4V 和Gemini,甚至在某些方面展现了超越人类能力的表现。但是,开源模型的性能还远远落后于闭源模型,最近许多开创性的研究,例如:MonKey、LLaVAR、TG-Doc、ShareGPT4V 等已经开始关注指令微调数据不足的问题。尽管这些努力取得了显着的效果,但仍存在一些问题,图像描述数据和 VQA 数据属于不同的领域,图像内容呈现的粒度和范围存在不一致性。此外,合成数据的规模相对较小,使得 MLLM 无法充分发挥潜力。

论文标题:TextSquare: Scaling up Text-Centric Visual Instruction Tuning

论文地址:https ://arxiv.org/abs/2404.12803

为了减少这一

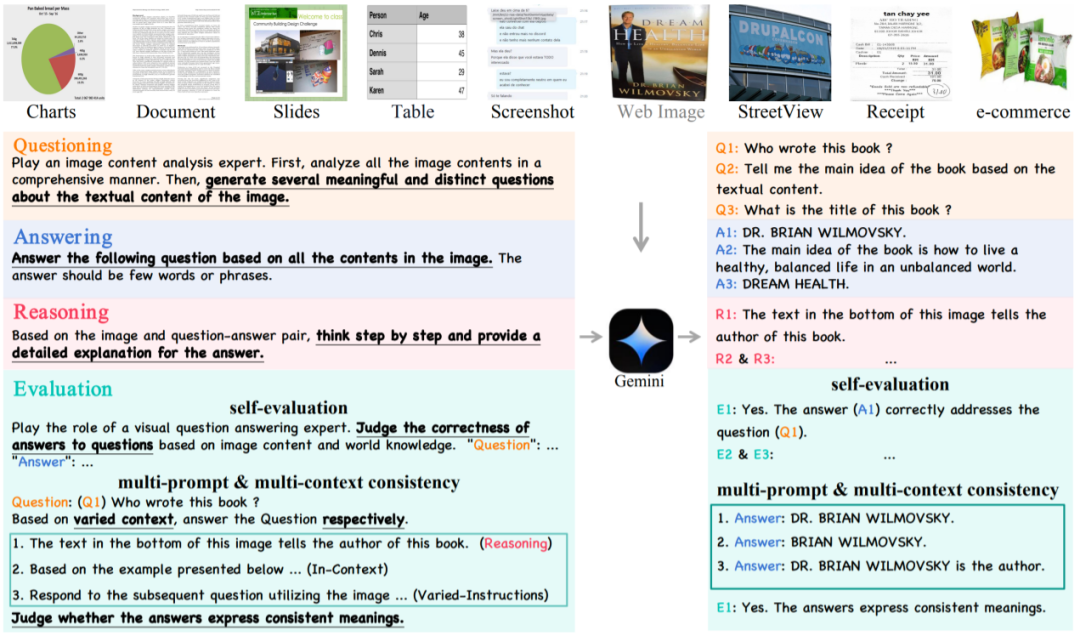

VQA 数据生成

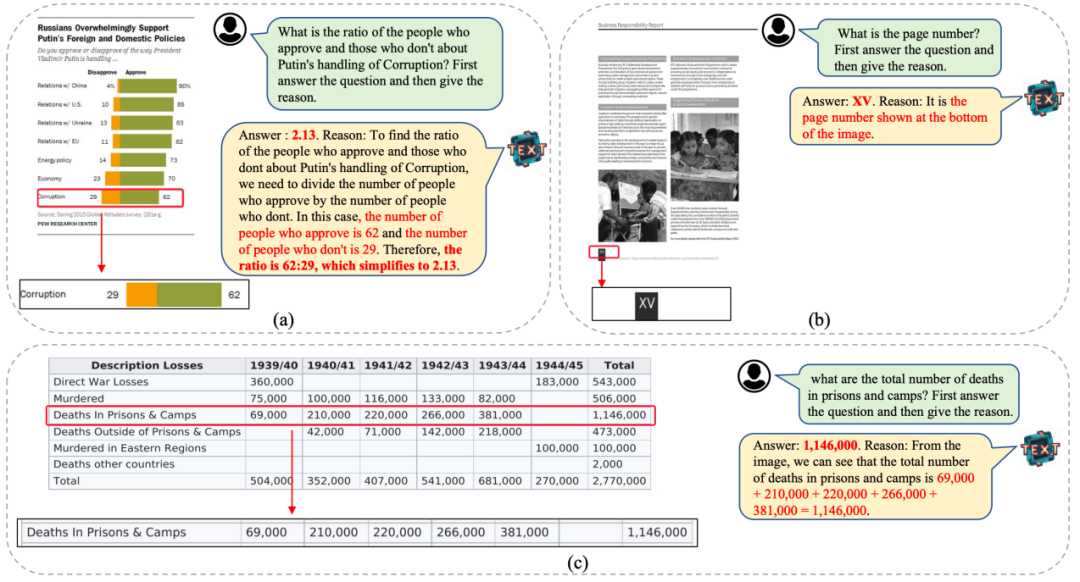

Square 策略方法包括四个步骤:自问(Self-Questioning)、回答(Self-Answering)、推理(Self-Reasoning) 和评估(Self-Evaluation)。 Self-Questioning 利用MLLM 在文本图像分析和理解方面的能力生成与图像中文本内容相关的问题。 Self-Answering 利用各种提示技术,如:思维链 CoT 和少样本,提供回答这些问题。 Self-Reasoning 利用MLLMs 强大的推理能力,生成模型背后的推理过程。 Self-Evaluation 评估问题的有效性、与图像文本内容的相关性以及答案的准确性,从而提高数据质量并减少偏见。

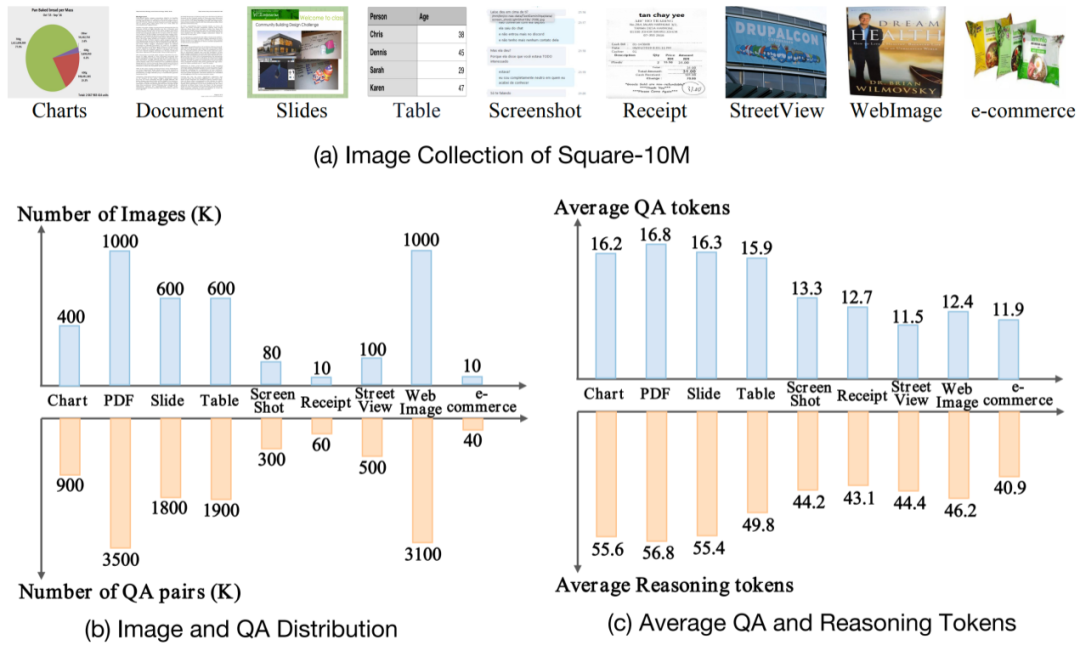

基于Square 方法,研究者从各种公共来源收集了一组多样化的含有大量文本的图像,包括自然场景、图表、表单、收据、书籍、PPT、PDF 等构建了Square-10M,并基于这个数据集训练了以文本理解为中心的MLLM TextSquare-8B。

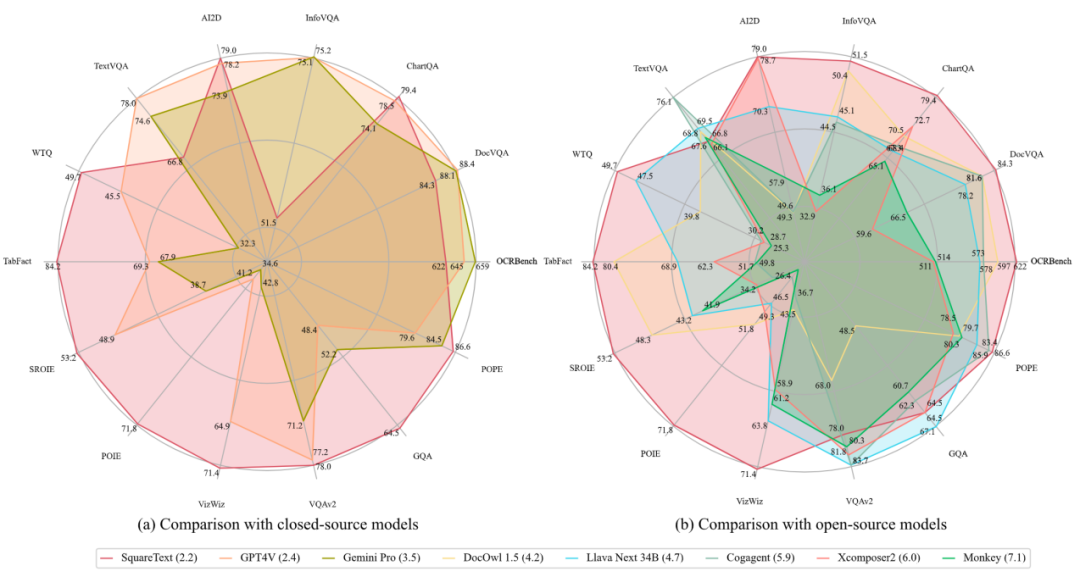

如图 1 所示,TextSquare-8B 在多个 benchmark 可取得与 GPT4V 和 Gemini 相媲美或更优的效果,并显着超过了其他开源模型。 TextSquare 实验验证了推理数据对 VQA 任务的积极影响,证明了其能够在减少幻觉的同时提升模型性能。

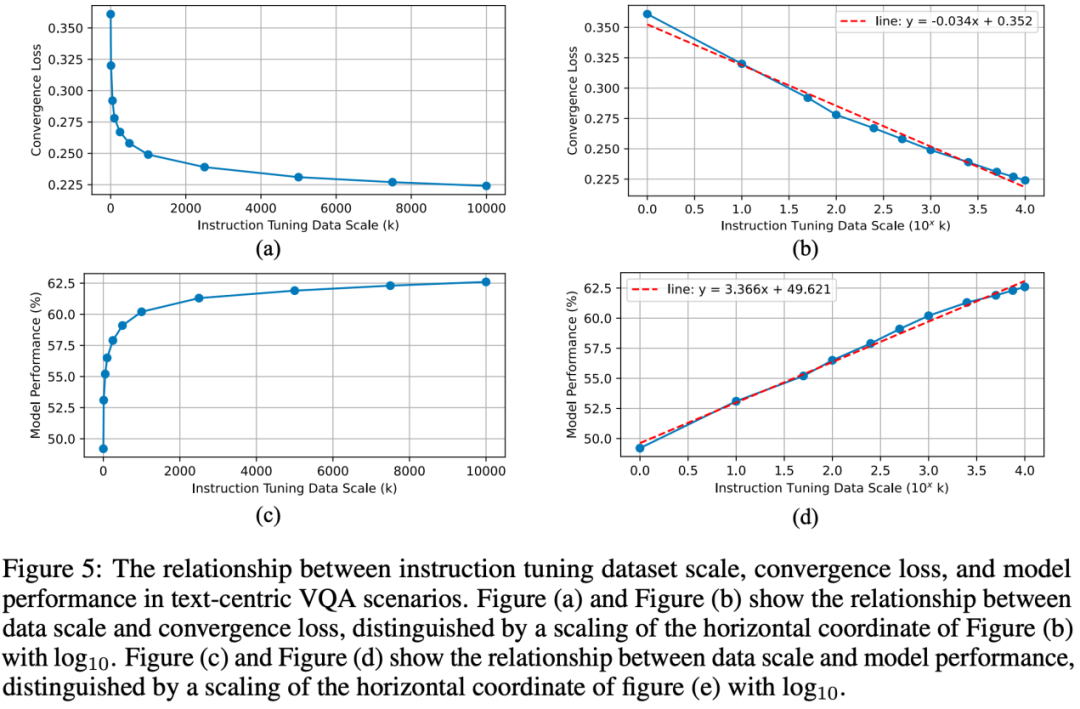

此外,通过利用大规模的数据集,揭示了指令调整数据规模、训练收敛损失和模型性能之间的关系。尽管少量的指令调整数据可以很好地训练 MLLM,随着指令调整数据的不断扩大,模型的性能能得到进一步增长,指令微调数据和模型之间也存在着相对应的 scaling law。

图3 Square-10M 的图像分布和QA 分布等详细情况

数据收集

数据收集策略的主要目标是涵盖广泛的现实世界文本丰富的场景。为此,研究者收集了 380 万张的富文本的图像。这些图像表现出不同的特性,例如,图表和表格侧重于具有密集统计信息的文本元素;PPT、屏幕截图和 WebImage 是为文本和突出视觉信息之间的交互而设计的;文档 / PDF、收据和电子商务包含具有精细和密集文本的图像;街景源于自然场景。收集到的图像形成了现实世界中文本元素的映射,并构成了研究以文本为中心的 VQA 的基础。

数据生成

研究者利用 Gemini Pro 的多模态理解能力从特定数据源选择图像,并通过自问、自答、自我推理三个阶段生成 VQA 及推理上下文对。

Self-Question: 这个阶段会给定一些 prompt,Gemini Pro 会根据这些提示对图像进行全面分析,并根据理解去生成一些有意义的问题。考虑到通用 MLLM 对文本元素的理解能力通常会比视觉模型弱,我们通过专门的 OCR 模型将提取的文本预处理到 prompt 中去。

Self-Answering: Gemini Pro对生成问题会利用思维链 (CoT) 和少样本提示 (few-shot prompting) 等技术丰富上下文信息,提高生成答案的可靠性。

Self-Reasoning: 这个阶段会生成答案的详细原因,迫使 Gemini Pro 更多的思考问题和视觉元素之间的联系,从而减少幻觉并提高准确的答案。

数据过滤

尽管自我提问、回答和推理是有效的,但生成的图像 - 文本对可能面临幻觉内容、无意义问题和错误答案。因此,我们设计了基于 LLM 的评估能力的过滤规则,以选择高质量的 VQA 对。

Self-Evaluation 提示 Gemini Pro 和其他 MLLMs 判断生成的问题是否有意义,以及答案是否足以正确解决问题。

Multi-Prompt Consistency 除了直接评估生成的内容外,研究者还在数据生成中手动增加提示和上下文空间。当提供不同的提示时,一个正确且有意义的 VQA 对应该在语义上一致。

Multi-Context Consistency 研究者通过在问题前准备不同的上下文信息来进一步验证 VQA 对。

TextSquare-8B

TextSquare-8B 借鉴了 InternLM-Xcomposer2 的模型结构,包括 CLIP ViT-L-14-336 的视觉 Encoder,图像分辨率进一步提升至 700;基于 InternLM2-7B-ChatSFT 的大语言模型 LLM;一个对齐视觉和文本 token 的桥接器 projector。

TextSquare-8B 的训练包括三阶段的 SFT:

第一阶段,以 490 的分辨率全参数 (Vision Encoder, Projector, LLM) 微调模型。

第二阶段,输入分辨率增加到 700,只训练 Vision Encoder 以适应分辨率变化。

第三阶段,进一步以 700 的分辨率进行全参数微调。

TextSquare 证实,在 Square-10M 数据集的基础上,具有 8B 参数和正常大小图像分辨率的模型可以在以文本为中心的 VQA 上实现超过了大多数的 MLLM,甚至是闭源模型 (GPT4V、Gemini Pro) 的效果。

实验结果

图 4(a)显示 TextSquare 具有简单的算术功能。图 4(b)显示了理解文本内容并在密集文本中提供大致位置的能力。图 4(c)显示了 TextSquare 对表格结构的理解能力。

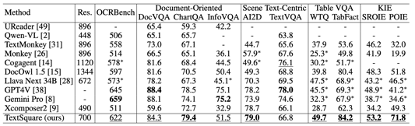

MLLM Benchmark

Document-Oriented Benchmark 在文档场景的 VQA Benckmark (DocVQA、ChartQA、InfographicVQA) 上平均提升 3.5%,优于所有开源模型,在 ChartQA 数据集上略高于 GPT4V 和 Gemini Pro,该模型分辨率仅 700,小于大多数面向文档的 MLLM,如果分辨率进一步提高,相信模型性能也将进一步提高,Monkey 已证明这一点。

Scene Text-centric Benchmark 自然场景的 VQA Benchmark (TextVQA、AI2D) 中取得了 SOTA 的效果,但与 baseline Xcomposer2 相比没有较大改进,可能是因为 Xcomposer2 已经用了高质量的域内数据进行了充分优化。

Table VQA Benchmark 表格场景的 VQA Benchmark (WTQ、TabFact) 中取得到远超 GPT4V 及 Gemini Pro 的效果,分别超过其他 SOTA 模型 3%。

Text-centric KIE Benchmark 文本中心的关键信息提取KIE 任务的benchmark (SROIE、POIE),将KIE 任务转换成VQA 任务,在两个数据集都取得了最佳的性能,平均提升14.8%。

OCRBench 包括文本识别、公式识别、文本中心VQA、KIE 等29 项OCR 相关的评估任务,取得了开源模型的最佳性能,并成为第一个10B 左右参数量达到600 分的模型。

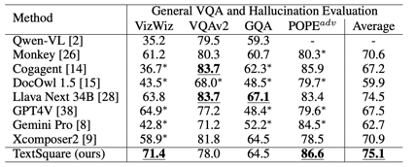

General VQA and Hallucination Evaluation Benchmark 在通用的VQA Benchmark (VizWiz VQAv2、GQA、 POPE) 上TextSquare 相较于Xconposer2 没有显着退化,仍然保持着最佳的性能,在VisWiz 和POPE 表现出显着的性能,比各最佳的方法高出3.6%,这突出了该方法的有效性,能减轻模型幻觉。

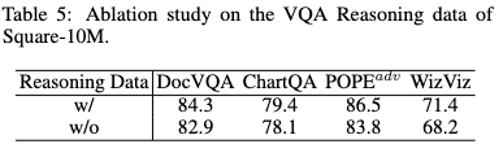

消融实验

TextSquare 相较于Xcomposer2 在各benchmark 平均提升7.7%。

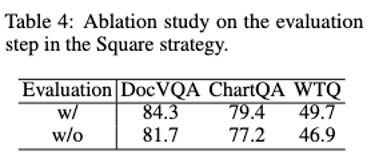

加入自评估后,模型性能有了明显提升。

加入推理数据后有助于显着提升性能以及减轻幻觉生成。

数据规模和收敛loss & 模型性能关系

随着数据规模的增长,模型的loss 继续减少,而下降速度逐渐变慢。收敛损失和指令调整数据尺度之间的关系近似符合对数函数。

随着指令调优数据的增长,模型的性能越来越好,但增长速度继续放缓,也大致符合对数函数。

总体而言,在以文本为中心的VQA 场景中,在指令调整阶段存在相应的缩放定律,其中模型性能与数据缩放的对数成正比,可以指导潜在更大数据集的构建并预测模型性能。

总结

在本文中,研究者提出了构建高质量的以文本为中心的指令调优数据集(Square-10M)的Square 策略,利用该数据集,TextSquare-8B 在多个benchmark 上实现了与GPT4V 相当的性能,并在各种基准测试上大幅优于最近发布的开源模型。

此外,研究者推导了指令调整数据集规模、收敛损失和模型性能之间的关系,以便为构建更大的数据集铺平道路,证实了数据的数量和质量对模型性能至关重要。

最后,研究者指出,如何进一步提高数据数量和质量以缩小开源模型与领先模型之间的差距,被认为一个有高度希望的研究方向。

以上是8B文字多模态大模型指标逼近GPT4V,字节、华师、华科联合提出TextSquare的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

ControlNet作者又出爆款!一张图生成绘画全过程,两天狂揽1.4k Star

Jul 17, 2024 am 01:56 AM

ControlNet作者又出爆款!一张图生成绘画全过程,两天狂揽1.4k Star

Jul 17, 2024 am 01:56 AM

同样是图生视频,PaintsUndo走出了不一样的路线。ControlNet作者LvminZhang又开始整活了!这次瞄准绘画领域。新项目PaintsUndo刚上线不久,就收获1.4kstar(还在疯狂涨)。项目地址:https://github.com/lllyasviel/Paints-UNDO通过该项目,用户输入一张静态图像,PaintsUndo就能自动帮你生成整个绘画的全过程视频,从线稿到成品都有迹可循。绘制过程,线条变化多端甚是神奇,最终视频结果和原图像非常相似:我们再来看一个完整的绘

登顶开源AI软件工程师榜首,UIUC无Agent方案轻松解决SWE-bench真实编程问题

Jul 17, 2024 pm 10:02 PM

登顶开源AI软件工程师榜首,UIUC无Agent方案轻松解决SWE-bench真实编程问题

Jul 17, 2024 pm 10:02 PM

AIxiv专栏是本站发布学术、技术内容的栏目。过去数年,本站AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com这篇论文的作者均来自伊利诺伊大学香槟分校(UIUC)张令明老师团队,包括:StevenXia,四年级博士生,研究方向是基于AI大模型的自动代码修复;邓茵琳,四年级博士生,研究方

OpenAI超级对齐团队遗作:两个大模型博弈一番,输出更好懂了

Jul 19, 2024 am 01:29 AM

OpenAI超级对齐团队遗作:两个大模型博弈一番,输出更好懂了

Jul 19, 2024 am 01:29 AM

如果AI模型给的答案一点也看不懂,你敢用吗?随着机器学习系统在更重要的领域得到应用,证明为什么我们可以信任它们的输出,并明确何时不应信任它们,变得越来越重要。获得对复杂系统输出结果信任的一个可行方法是,要求系统对其输出产生一种解释,这种解释对人类或另一个受信任的系统来说是可读的,即可以完全理解以至于任何可能的错误都可以被发现。例如,为了建立对司法系统的信任,我们要求法院提供清晰易读的书面意见,解释并支持其决策。对于大型语言模型来说,我们也可以采用类似的方法。不过,在采用这种方法时,确保语言模型生

arXiv论文可以发「弹幕」了,斯坦福alphaXiv讨论平台上线,LeCun点赞

Aug 01, 2024 pm 05:18 PM

arXiv论文可以发「弹幕」了,斯坦福alphaXiv讨论平台上线,LeCun点赞

Aug 01, 2024 pm 05:18 PM

干杯!当论文讨论细致到词句,是什么体验?最近,斯坦福大学的学生针对arXiv论文创建了一个开放讨论论坛——alphaXiv,可以直接在任何arXiv论文之上发布问题和评论。网站链接:https://alphaxiv.org/其实不需要专门访问这个网站,只需将任何URL中的arXiv更改为alphaXiv就可以直接在alphaXiv论坛上打开相应论文:可以精准定位到论文中的段落、句子:右侧讨论区,用户可以发表问题询问作者论文思路、细节,例如:也可以针对论文内容发表评论,例如:「给出至

公理训练让LLM学会因果推理:6700万参数模型比肩万亿参数级GPT-4

Jul 17, 2024 am 10:14 AM

公理训练让LLM学会因果推理:6700万参数模型比肩万亿参数级GPT-4

Jul 17, 2024 am 10:14 AM

把因果链展示给LLM,它就能学会公理。AI已经在帮助数学家和科学家做研究了,比如著名数学家陶哲轩就曾多次分享自己借助GPT等AI工具研究探索的经历。AI要在这些领域大战拳脚,强大可靠的因果推理能力是必不可少的。本文要介绍的这项研究发现:在小图谱的因果传递性公理演示上训练的Transformer模型可以泛化用于大图谱的传递性公理。也就是说,如果让Transformer学会执行简单的因果推理,就可能将其用于更为复杂的因果推理。该团队提出的公理训练框架是一种基于被动数据来学习因果推理的新范式,只有演示

黎曼猜想显着突破!陶哲轩强推MIT、牛津新论文,37岁菲尔兹奖得主参与

Aug 05, 2024 pm 03:32 PM

黎曼猜想显着突破!陶哲轩强推MIT、牛津新论文,37岁菲尔兹奖得主参与

Aug 05, 2024 pm 03:32 PM

最近,被称为千禧年七大难题之一的黎曼猜想迎来了新突破。黎曼猜想是数学中一个非常重要的未解决问题,与素数分布的精确性质有关(素数是那些只能被1和自身整除的数字,它们在数论中扮演着基础性的角色)。在当今的数学文献中,已有超过一千条数学命题以黎曼猜想(或其推广形式)的成立为前提。也就是说,黎曼猜想及其推广形式一旦被证明,这一千多个命题将被确立为定理,对数学领域产生深远的影响;而如果黎曼猜想被证明是错误的,那么这些命题中的一部分也将随之失去其有效性。新的突破来自MIT数学教授LarryGuth和牛津大学

首个基于Mamba的MLLM来了!模型权重、训练代码等已全部开源

Jul 17, 2024 am 02:46 AM

首个基于Mamba的MLLM来了!模型权重、训练代码等已全部开源

Jul 17, 2024 am 02:46 AM

AIxiv专栏是本站发布学术、技术内容的栏目。过去数年,本站AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com。引言近年来,多模态大型语言模型(MLLM)在各个领域的应用取得了显着的成功。然而,作为许多下游任务的基础模型,当前的MLLM由众所周知的Transformer网络构成,这种网

LLM用于时序预测真的不行,连推理能力都没用到

Jul 15, 2024 pm 03:59 PM

LLM用于时序预测真的不行,连推理能力都没用到

Jul 15, 2024 pm 03:59 PM

语言模型真的能用于时序预测吗?根据贝特里奇头条定律(任何以问号结尾的新闻标题,都能够用「不」来回答),答案应该是否定的。事实似乎也果然如此:强大如斯的LLM并不能很好地处理时序数据。时序,即时间序列,顾名思义,是指一组按照时间发生先后顺序进行排列的数据点序列。在很多领域,时序分析都很关键,包括疾病传播预测、零售分析、医疗和金融。在时序分析领域,近期不少研究者都在研究如何使用大型语言模型(LLM)来分类、预测和检测时间序列中的异常。这些论文假设擅长处理文本中顺序依赖关系的语言模型也能泛化用于时间序