当前最强国产Sora!清华团队突破16秒长视频,懂多镜头语言,会模拟物理规律

你说箱子里要装满钻石,于是箱子被钻石填满,比实拍还要耀眼。这样的技能,哪个剧组不喜欢?

这是前段时间Adobe旗下的视频剪辑软件Premiere Pro所呈现的“魔法”。该软件通过引入Sora、Runway、Pika等AI视频工具,实现在视频中添加物体、消除物体以及生成视频片段等能力,这被视为视频领域的再一次技术革新。

从 2 月份 Sora 席卷全球到如今 Adobe 再施魔法,海外热火朝天。相比之下,国内在视频领域,尤其是长视频生成方向还处于「等待」状态。在过去的两个月里,我们已经听到了一些宣称追赶 Sora 的声音,但是目前还没有看到国内取得明显进展。但今天生数科技刚刚发布的这支短片,让我们看到了不少惊喜。

这是生数科技联合清华大学最新发布的视频大模型「Vidu」所官宣的视频。可以看出,它生成的视频不再是持续几秒的「GIF」,而是达到了十几秒(最长可以达到 16 秒左右)。当然更令人惊喜的是,「Vidu」画面效果非常接近 Sora,在多镜头语言、时间和空间一致性、遵循物理规律等方面表现都非常出色,而且还能虚构出真实世界不存在的超现实主义画面,这是当前的视频生成模型难以实现的。在短短两个月的时间,生数科技能实现到这般效果,着实令人惊喜。

国内首个全面对标 Sora 的视频模型

自 Sora 发布之后,“国产 Sora”的争夺战就打响了。但当行业都聚焦于“长”这一特性时,却都忽略了 Sora 的背后其实是综合效果的提升,例如长时间序下的一致性、真实度、美观性等等。

从综合效果看,「Vidu」是首个也是唯一在效果层面全面对标 Sora 的视频模型,不仅仅在国内,在全球范围,也是继 Sora 之后首个完成突破的视频模型。从具体效果,可以显著看到几处明显的优势:

给视频注入「镜头语言」

在视频制作中有一个非常重要的概念——镜头语言。它是通过画面来表达故事情节、揭示角色心理、营造氛围以及引导观众情感的主要方式。不同的镜头选择、角度、运动和组合将极大地影响叙事的效果和观众的感受。

现有 AI 生成的视频,能够明显地感觉到镜头语言的单调,镜头的运动局限于轻微幅度的推、拉、移等简单镜头。其背后的主要原因是,现有的视频内容生成大多是先通过生成单帧画面,再做连续的前后帧预测,但主流的技术路径,很难做到长时序的连贯预测,只能做到小幅的动态预测。

Runway 在去年 7 月份生成的科幻电影预告片《Trailer: Genesis》(《创世纪》)。

「Vidu」则突破了这些局限。在一个「海边小屋」为主题的片段中,我们可以看到,「Vidu」一次生成的一段片段中涉及多个镜头,画面既有小屋的近景特写,也有望向海面的远眺,整体看下来有种从屋内到走廊再到栏杆边赏景的叙事感。可以看出,「Vidu」能够围绕统一主体在一段画面里实现远景、近景、中景、特写等不同镜头的切换。

提示:在一个古色古香的海边小屋里,阳光沐浴着房间,镜头缓慢过渡到一个阳台,俯瞰着宁静的大海,最后镜头定格在漂浮着大海、帆船和倒影般的云彩。(生数旗下 PixWeaver 产品官网放出的完整视频片段)

此外,从短片中的多个片段能看到,「Vidu」能直接生成转场、追焦、长镜头等效果,包括能够生成影视级的镜头画面,给视频注入镜头语言,提升画面的整体叙事感。

保持时间和空间的一致性

视频画面的连贯和流畅性至关重要,这背后其实是人物和场景的时空一致性,比如人物在空间中的运动始终保持一致,场景也不能在没有任何转场的情况下突变。而这一点 AI 很难实现,尤其时长一长,AI 生成的视频将出现叙事断裂、视觉不连贯、逻辑错误等问题, 这些问题会严重影响视频的真实感和观赏性。

「Vidu」在一定程度上克服了这些问题。从它生成的一段「带珍珠耳环的猫」的视频中可以看到,随着镜头的移动,作为画面主体的猫在 3D 空间下一直保持着表情、服饰的一致,视频整体上非常连贯、流畅,保持了很好的时间、空间一致性。

提示:这是一只蓝眼睛的橙色猫的肖像,慢慢地旋转,灵感来自维米尔的《戴珍珠耳环的少女》,画面上戴着珍珠耳环,棕色头发像荷兰帽一样,黑色背景,工作室灯光。(生数旗下 PixWeaver 产品官网放出的完整视频片段)

模拟真实物理世界

Sora 令人惊艳的一大特点,就是能够模拟真实物理世界的运动,例如物体的移动和相互作用。其中 Sora 发布过的一个经典案例 ——「一辆老式 SUV 行驶在山坡上」的画面,非常好地模拟了轮胎扬起的灰尘、树林中的光影以及车行驶过程中的阴影变化。在同样的提示词下,「Vidu」与 Sora 生成效果高度接近,灰尘、光影等细节与人类在真实物理世界中的体验非常接近。 提示:镜头跟随一辆带有黑色车顶行李架的白色老式 SUV,它在陡峭的山坡上一条被松树环绕的陡峭土路上加速行驶,轮胎扬起灰尘,阳光照射在 SUV 上,给整个场景投射出温暖的光芒。土路缓缓地蜿蜒延伸至远方,看不到其他汽车或车辆。道路两旁都是红杉树,零星散落着一片片绿意。从后面看,这辆车轻松地沿着曲线行驶,看起来就像是在崎岖的地形上行驶。土路周围是陡峭的丘陵和山脉,上面是清澈的蓝天和缕缕云彩。(生数旗下 PixWeaver 产品官网放出的完整视频片段)

提示:镜头跟随一辆带有黑色车顶行李架的白色老式 SUV,它在陡峭的山坡上一条被松树环绕的陡峭土路上加速行驶,轮胎扬起灰尘,阳光照射在 SUV 上,给整个场景投射出温暖的光芒。土路缓缓地蜿蜒延伸至远方,看不到其他汽车或车辆。道路两旁都是红杉树,零星散落着一片片绿意。从后面看,这辆车轻松地沿着曲线行驶,看起来就像是在崎岖的地形上行驶。土路周围是陡峭的丘陵和山脉,上面是清澈的蓝天和缕缕云彩。(生数旗下 PixWeaver 产品官网放出的完整视频片段)  Sora的生成效果。

Sora的生成效果。

当然在「带有黑色车顶行李架」的局部细节上,「Vidu」没能生成出来。但瑕不掩瑜,它的整体效果已高度接近真实世界。

丰富的想象力

与实景拍摄相比,用 AI 生成视频有一个很大的优势 —— 它可以生成现实世界中不存在的画面。以往,这些画面往往要花费很大的人力、物力去搭建或做成特效,但是 AI 短时间就可以自动生成了。

比如在下面这个场景中,「帆船」、「海浪」罕见地出现在了画室里,而且海浪与帆船的交互动态非常自然。

提示:画室里的一艘船驶向镜头。(生数旗下 PixWeaver 产品官网放出的完整视频片段)

短片中的「鱼缸女孩」的片段也是奇幻但又具有一定的合理感。这种能够虚构真实世界不存在的画面的能力,对于创作超现实主义内容非常有帮助,不仅可以激发创作者的灵感,提供新颖的视觉体验,还能拓宽艺术表达的边界,带来更加丰富和多元化的内容形式。

理解中国元素

除了以上四方面的特点外,我们从「Vidu」放出的短片中还看到了一些不一样的惊喜,「Vidu」能够生成特有中国元素的画面,比如熊猫、龙、宫殿场景等。

提示:在宁静的湖边,一只熊猫热切地弹着吉他,让整个环境变得活跃起来。晴朗天空下平静的水面倒映着这一场景,以生动的全景镜头捕捉到,将现实主义与大熊猫活泼的精神融为一体,创造出活力与平静的和谐融合。(生数旗下 PixWeaver 产品官网放出的完整视频片段)

两个月快速突破,背后是怎么做到的?

「Vidu」背后的研发团队生数科技是国内多模态大模型方向的创业团队,核心成员来自清华大学人工智能研究院,团队专注于图像、3D、视频等多模态生成领域。

在今年 1 月份,生数科技在旗下视觉创意设计平台 PixWeaver 就上线了短视频生成功能,支持 4 秒高美学性的短视频内容。2 月份 Sora 推出后,据悉,生数科技内部成立了正式的攻坚小组,加快了原本视频方向的研发进度,3 月份内部就实现了 8 秒的视频生成,紧接着 4 月份就突破了 16 秒生成,生成质量与时长全方面取得突破。

众所周知,Sora 并没有公布太多的技术细节,能在这么短的时间内取得突破,背后核心是团队深厚的技术积累和诸多从 0 到 1 的原创成果,尤其是在最核心的技术架构层面。

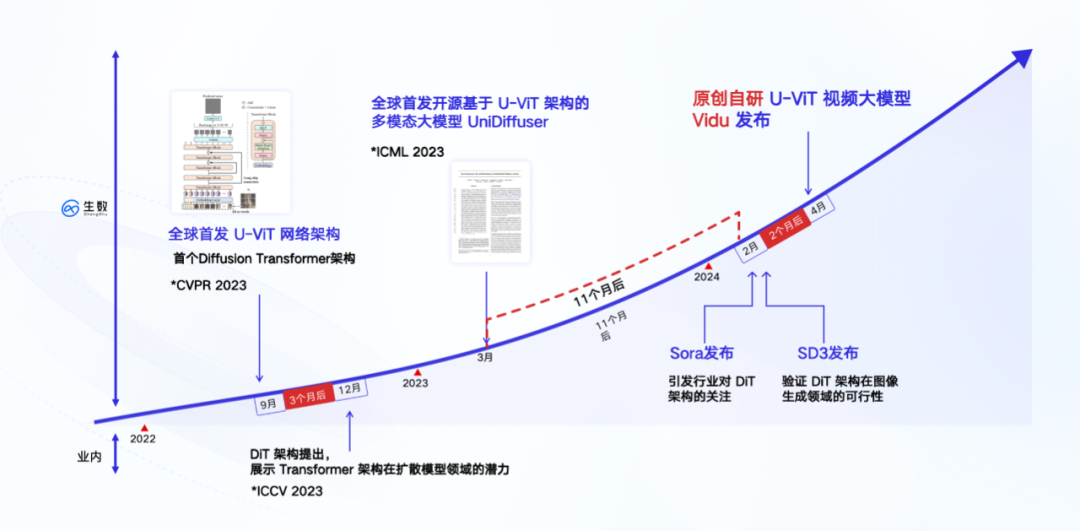

「Vidu」底层基于完全自研的 U-ViT 架构,该架构由团队在 2022 年 9 月提出,早于 Sora 采用的 DiT 架构,是全球首个 Diffusion 和 Transformer 融合的架构。

在 DiT 论文发布两个月前,清华大学的朱军团队提交了一篇论文 ——《All are Worth Words: A ViT Backbone for Diffusion Models》。这篇论文提出了用 Transformer 替代基于 CNN 的 U-Net 的网络架构 U-ViT。这是「Vidu」最重要的技术基础。

在技术路线上,「Vidu」采用了和 Sora 完全一致的 Diffusion 和 Transformer 融合的架构。不同于采用插帧的多步骤处理方式来达到长视频的生成,「Vidu」采用的是和 Sora 一致的路线,即通过单一步骤直接生成高质量的视频。从底层来看,这是一种「一步到位」的实现方法,基于单一模型完全端到端生成,不涉及中间的插帧和其他多步骤的处理,文本到视频的转换是直接且连续的。

另外基于 U-ViT 架构,2023 年 3 月,团队在开源的大规模图文数据集 LAION-5B 上训练了 10 亿参数量的多模态模型 ——UniDiffuser,并将其开源(参见《清华朱军团队开源首个基于 Transformer 的多模态扩散大模型,文图互生、改写全拿下》)。

UniDiffuser 主要擅长图文任务,能支持图文模态间的任意生成和转换。UniDiffuser 的实现有一项重要的价值 —— 首次验证了融合架构在大规模训练任务中的可扩展性(Scaling Law),相当于将 U-ViT 架构在大规模训练任务中的所有环节流程都跑通。值得一提的,UniDiffuser 比同样 DiT 架构的图文模型 Stable Diffusion 3 的提出领先了一年。

这些在图文任务中积累的工程经验为视频模型的研发打下了基础。因为视频本质上是图像的流,相当于是图像在时间轴上做了一个扩增。因此,在图文任务上取得的成果往往能够在视频任务中得到复用。Sora 就是这么做的:它采用了 DALL・E 3 的重标注技术,通过为视觉训练数据生成详细的描述,使模型能够更加准确地遵循用户的文本指令生成视频。这种效应也必然会发生在「Vidu」上面。

根据此前的消息推测,「Vidu」也复用了生数科技在图文任务的很多经验,包括训练加速、并行化训练、低显存训练等等,从而快速跑通了训练流程。据悉,他们通过视频数据压缩技术降低输入数据的序列维度,同时采用自研的分布式训练框架,在保证计算精度的同时,通信效率提升 1 倍,显存开销降低 80%,训练速度累计提升 40 倍。

从图任务的统一到融合视频能力,「Vidu」可被视为一款通用视觉模型,能够支持生成更加多样化、更长时长的视频内容。官方也透露,「Vidu」目前还在加速迭代提升。面向未来,「Vidu」灵活的模型架构也将能够兼容更广泛的多模态能力。

来自清华系的精干团队

最后,再聊下「Vidu」背后的团队 —— 生数科技,这是一支清华背景的精干团队。

生数科技的核心团队来自清华大学人工智能研究院。首席科学家由清华人工智能研究院副院长朱军担任;CEO 唐家渝本硕就读于清华大学计算机系,是 THUNLP 组成员;CTO 鲍凡则是清华大学计算机系博士生、朱军教授的课题组成员,长期关注扩散模型领域研究,U-ViT 和 UniDiffuser 两项工作均是由他主导完成的。

团队从事生成式人工智能和贝叶斯机器学习的研究已有 20 余年,在深度生成模型突破的早期就开展了深入研究。在扩散模型方面,团队于国内率先开启了该方向的研究,成果涉及骨干网络、高速推理算法、大规模训练等全栈技术方向。

团队于 ICML、NeurIPS、ICLR 等人工智能顶会发表多模态领域相关论文近 30 篇,其中提出的免训练推理算法 Analytic-DPM、DPM-Solver 等突破性成果,获得 ICLR 杰出论文奖,并被 OpenAI、苹果、Stability.ai 等国外前沿机构采用,应用于 DALL・E 2、Stable Diffusion 等明星项目中。

自 2023 年成立以来,团队已获得蚂蚁集团、启明创投、BV 百度风投、字节系锦秋基金等多家知名产业机构的认可,完成数亿元融资。据悉,生数科技是目前国内在多模态大模型赛道估值最高的创业团队。此次「Vidu」的推出,是生数科技在多模态原生大模型领域的再一次创新和领先。

相关阅读:

《专访生数科技唐家渝:拿到上亿融资,Transformer 来做多模态大模型》

《国内公司有望做出 Sora 吗?这支清华系大模型团队给出了希望》

以上是当前最强国产Sora!清华团队突破16秒长视频,懂多镜头语言,会模拟物理规律的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

热门话题

DeepMind机器人打乒乓球,正手、反手溜到飞起,全胜人类初学者

Aug 09, 2024 pm 04:01 PM

DeepMind机器人打乒乓球,正手、反手溜到飞起,全胜人类初学者

Aug 09, 2024 pm 04:01 PM

但可能打不过公园里的老大爷?巴黎奥运会正在如火如荼地进行中,乒乓球项目备受关注。与此同时,机器人打乒乓球也取得了新突破。刚刚,DeepMind提出了第一个在竞技乒乓球比赛中达到人类业余选手水平的学习型机器人智能体。论文地址:https://arxiv.org/pdf/2408.03906DeepMind这个机器人打乒乓球什么水平呢?大概和人类业余选手不相上下:正手反手都会:对手采用多种打法,该机器人也能招架得住:接不同旋转的发球:不过,比赛激烈程度似乎不如公园老大爷对战。对机器人来说,乒乓球运动

首配机械爪!元萝卜亮相2024世界机器人大会,发布首个走进家庭的国际象棋机器人

Aug 21, 2024 pm 07:33 PM

首配机械爪!元萝卜亮相2024世界机器人大会,发布首个走进家庭的国际象棋机器人

Aug 21, 2024 pm 07:33 PM

8月21日,2024世界机器人大会在北京隆重召开。商汤科技旗下家用机器人品牌“元萝卜SenseRobot”家族全系产品集体亮相,并最新发布元萝卜AI下棋机器人——国际象棋专业版(以下简称“元萝卜国象机器人”),成为全球首个走进家庭的国际象棋机器人。作为元萝卜的第三款下棋机器人产品,全新的国象机器人在AI和工程机械方面进行了大量专项技术升级和创新,首次在家用机器人上实现了通过机械爪拾取立体棋子,并进行人机对弈、人人对弈、记谱复盘等功能,

Claude也变懒了!网友:学会给自己放假了

Sep 02, 2024 pm 01:56 PM

Claude也变懒了!网友:学会给自己放假了

Sep 02, 2024 pm 01:56 PM

开学将至,该收心的不止有即将开启新学期的同学,可能还有AI大模型。前段时间,Reddit上挤满了吐槽Claude越来越懒的网友。「它的水平下降了很多,经常停顿,甚至输出也变得很短。在发布的第一周,它可以一次性翻译整整4页文稿,现在连半页都输出不了了!」https://www.reddit.com/r/ClaudeAI/comments/1by8rw8/something_just_feels_wrong_with_claude_in_the/在一个名为「对Claude彻底失望了的帖子里」,满满地

世界机器人大会上,这家承载「未来养老希望」的国产机器人被包围了

Aug 22, 2024 pm 10:35 PM

世界机器人大会上,这家承载「未来养老希望」的国产机器人被包围了

Aug 22, 2024 pm 10:35 PM

正在北京举行的世界机器人大会上,人形机器人的展示成为了现场绝对的焦点,在星尘智能的展台上,由于AI机器人助理S1在一个展区上演扬琴、武术、书法三台大戏,能文能武,吸引了大量专业观众和媒体的驻足。在带弹性的琴弦上的优雅演奏,让S1展现出速度、力度、精度兼具的精细操作和绝对掌控。央视新闻对「书法」背后的模仿学习和智能控制进行了专题报道,公司创始人来杰解释到,丝滑动作的背后,是硬件侧追求最好力控和最仿人身体指标(速度、负载等),而是在AI侧则采集人的真实动作数据,让机器人遇强则强,快速学习进化。而敏捷

ACL 2024奖项公布:华科大破译甲骨文最佳论文之一、GloVe时间检验奖

Aug 15, 2024 pm 04:37 PM

ACL 2024奖项公布:华科大破译甲骨文最佳论文之一、GloVe时间检验奖

Aug 15, 2024 pm 04:37 PM

本届ACL大会,投稿者「收获满满」。为期六天的ACL2024正在泰国曼谷举办。ACL是计算语言学和自然语言处理领域的顶级国际会议,由国际计算语言学协会组织,每年举办一次。一直以来,ACL在NLP领域的学术影响力都位列第一,它也是CCF-A类推荐会议。今年的ACL大会已是第62届,接收了400余篇NLP领域的前沿工作。昨天下午,大会公布了最佳论文等奖项。此次,最佳论文奖7篇(两篇未公开)、最佳主题论文奖1篇、杰出论文奖35篇。大会还评出了资源论文奖(ResourceAward)3篇、社会影响力奖(

鸿蒙智行享界S9及全场景新品发布会,多款重磅新品齐发

Aug 08, 2024 am 07:02 AM

鸿蒙智行享界S9及全场景新品发布会,多款重磅新品齐发

Aug 08, 2024 am 07:02 AM

今天下午,鸿蒙智行正式迎来了新品牌与新车。 8月6日,华为举行鸿蒙智行享界S9及华为全场景新品发布会,带来了全景智慧旗舰轿车享界S9、问界新M7Pro和华为novaFlip、MatePadPro12.2英寸、全新MatePadAir、华为毕升激光打印机X1系列、FreeBuds6i、WATCHFIT3和智慧屏S5Pro等多款全场景智慧新品,从智慧出行、智慧办公到智能穿戴,华为全场景智慧生态持续构建,为消费者带来万物互联的智慧体验。鸿蒙智行:深度赋能,推动智能汽车产业升级华为联合中国汽车产业伙伴,为

分布式人工智能盛会DAI 2024征稿:Agent Day,强化学习之父Richard Sutton将出席!颜水成、Sergey Levine以及DeepMind科学家将做主旨报告

Aug 22, 2024 pm 08:02 PM

分布式人工智能盛会DAI 2024征稿:Agent Day,强化学习之父Richard Sutton将出席!颜水成、Sergey Levine以及DeepMind科学家将做主旨报告

Aug 22, 2024 pm 08:02 PM

会议简介随着科技的飞速发展,人工智能已经成为了推动社会进步的重要力量。在这个时代,我们有幸见证并参与到分布式人工智能(DistributedArtificialIntelligence,DAI)的创新与应用中。分布式人工智能是人工智能领域的重要分支,这几年引起了越来越多的关注。基于大型语言模型(LLM)的智能体(Agent)异军突起,通过结合大模型的强大语言理解和生成能力,展现出了在自然语言交互、知识推理、任务规划等方面的巨大潜力。AIAgent正在接棒大语言模型,成为当前AI圈的热点话题。Au

李飞飞团队提出ReKep,让机器人具备空间智能,还能整合GPT-4o

Sep 03, 2024 pm 05:18 PM

李飞飞团队提出ReKep,让机器人具备空间智能,还能整合GPT-4o

Sep 03, 2024 pm 05:18 PM

视觉与机器人学习的深度融合。当两只机器手丝滑地互相合作叠衣服、倒茶、将鞋子打包时,加上最近老上头条的1X人形机器人NEO,你可能会产生一种感觉:我们似乎开始进入机器人时代了。事实上,这些丝滑动作正是先进机器人技术+精妙框架设计+多模态大模型的产物。我们知道,有用的机器人往往需要与环境进行复杂精妙的交互,而环境则可被表示成空间域和时间域上的约束。举个例子,如果要让机器人倒茶,那么机器人首先需要抓住茶壶手柄并使之保持直立,不泼洒出茶水,然后平稳移动,一直到让壶口与杯口对齐,之后以一定角度倾斜茶壶。这